- Data Hackers Newsletter

- Posts

- Vazamento do Claude Code: código-fonte revela segredos da IA de US$ 2,5 bilhões da Anthropic

Vazamento do Claude Code: código-fonte revela segredos da IA de US$ 2,5 bilhões da Anthropic

Entenda como ocorreu o vazamento, os segredos que foram descobertos e suas implicações

A Anthropic pode ter acabado de sofrer um dos vazamentos mais significativos da história recente da inteligência artificial. O código-fonte completo do Claude Code, seu agente de IA responsável por uma receita anualizada de US$ 2,5 bilhões, foi acidentalmente exposto ao público através do registro npm.

Na manhã de 31 de março de 2026, um arquivo de mapa de origem JavaScript de 59,8 MB foi incluído inadvertidamente na versão 2.1.88 do pacote @anthropic-ai/claude-code no registro público npm. O vazamento foi descoberto por Chaofan Shou, estagiário do Solayer Labs, às 4h23 (horário do leste dos EUA), que rapidamente compartilhou a descoberta no X (antigo Twitter).

Em poucas horas, a base de código TypeScript de aproximadamente 512.000 linhas foi espelhada no GitHub e analisada por milhares de desenvolvedores ao redor do mundo. Para a Anthropic, empresa que reportou uma taxa de receita anualizada de US$ 19 bilhões em março de 2026, o incidente representa mais do que um simples lapso de segurança: é uma exposição estratégica massiva de propriedade intelectual.

O que o vazamento revelou sobre a arquitetura do Claude Code

Sistema de memória de três camadas: a solução para a "entropia de contexto"

Uma das descobertas mais importantes do vazamento está na forma como a Anthropic resolveu um dos maiores desafios dos agentes de IA: a "entropia de contexto". Este fenômeno ocorre quando agentes ficam confusos ou começam a alucinar à medida que sessões de longa duração crescem em complexidade.

O código-fonte revela uma arquitetura sofisticada de memória de três camadas que se afasta da abordagem tradicional de "armazenar tudo":

Camada | Função | Características |

|---|---|---|

Índice leve de ponteiros | ~150 caracteres por linha, carregado perpetuamente no contexto | |

Arquivos de tópico | Conhecimento do projeto | Dados obtidos sob demanda, não armazenados permanentemente |

Transcrições brutas | Histórico completo | Nunca totalmente lidas, apenas pesquisadas via "grep" para identificadores específicos |

Esta arquitetura implementa o que desenvolvedores estão chamando de "Memória Self-Therapeutic". O sistema utiliza uma "Disciplina Estrita de Gravação", onde o agente só pode atualizar seu índice após uma gravação de arquivo bem-sucedida. Isso evita que o modelo polua seu contexto com tentativas fracassadas.

Para os concorrentes, o recado é claro: construir uma memória cética, onde o agente trata sua própria memória como uma "dica" e sempre verifica os fatos em relação à base de código atual antes de prosseguir.

KAIROS: o modo daemon autônomo

O vazamento também expôs o "KAIROS", conceito da Grécia Antiga que significa "na hora certa". Mencionado mais de 150 vezes no código-fonte, o KAIROS representa uma mudança fundamental na experiência do usuário: um modo daemon autônomo.

Diferentemente das ferramentas atuais de IA que são amplamente reativas, o KAIROS permite que Claude Code opere como um agente de segundo plano sempre ativo. Ele lida com sessões em background e emprega um processo chamado autoDream.

Como funciona o autoDream

Neste modo, o agente realiza "consolidação de memória" enquanto o usuário está ocioso:

Mescla observações díspares

Remove contradições lógicas

Converte insights vagos em fatos absolutos

Essa manutenção em segundo plano garante que, quando o usuário retornar, o contexto do agente esteja limpo e altamente relevante. A implementação de um subagente bifurcado para executar essas tarefas revela uma abordagem de engenharia madura para evitar que a "linha de pensamento" do agente principal seja corrompida por suas próprias rotinas de manutenção.

Modelos internos e métricas de desempenho reveladas

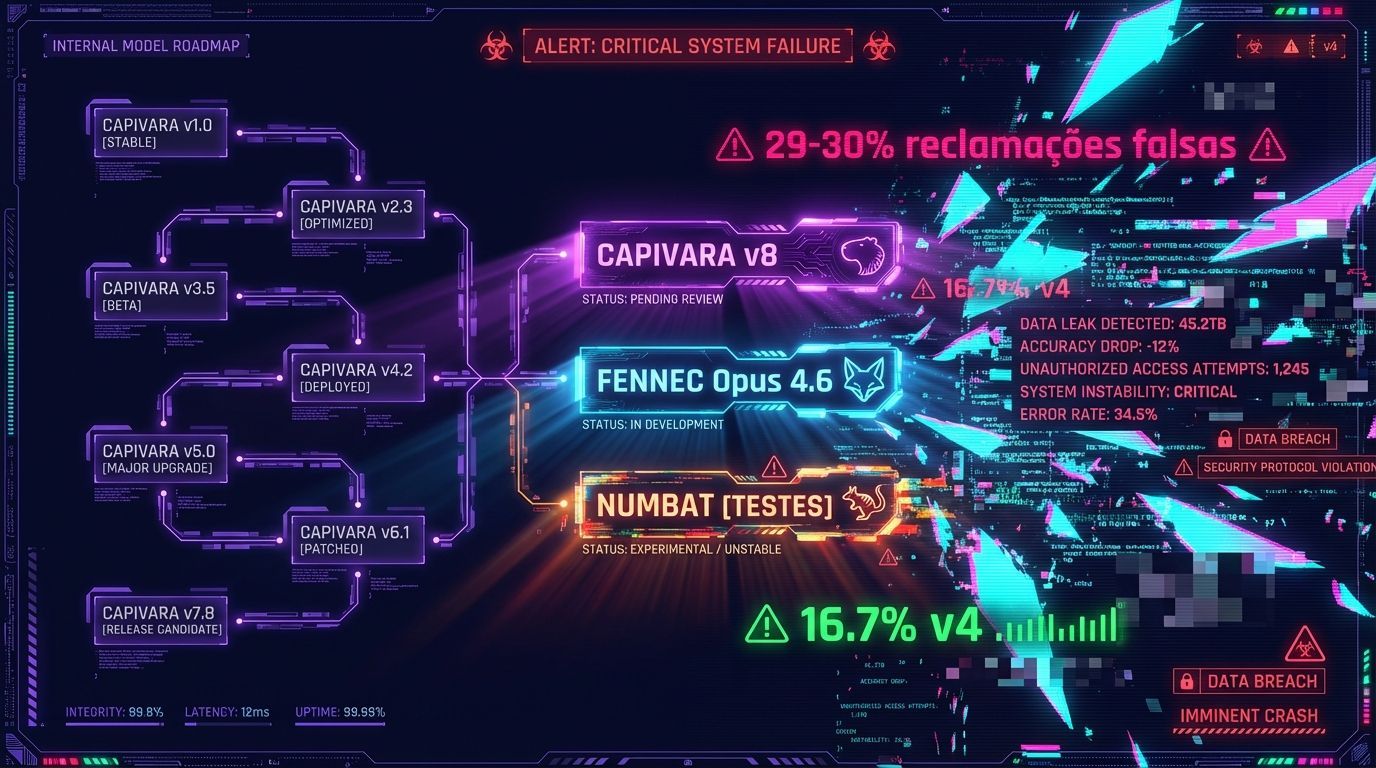

O código-fonte fornece uma visão rara do roteiro interno de modelos da Anthropic e dos desafios do desenvolvimento de fronteira. O vazamento confirma os codinomes internos de variantes não divulgadas:

Capivara: variante Claude 4.6

Fennec: mapeado para Opus 4.6

Numbat: ainda em testes, não lançado

Comentários internos revelam que a Anthropic já está iterando no Capybara v8, mas o modelo ainda enfrenta obstáculos significativos:

Taxa de reclamações falsas de 29-30% na v8

Regressão em comparação com a taxa de 16,7% observada na v4

"Contrapeso de assertividade" para evitar refatoradores agressivos

Para os concorrentes, essas métricas são inestimáveis: fornecem uma referência do "teto" para o desempenho atual dos agentes e destacam as fraquezas específicas que a Anthropic ainda está lutando para resolver.

Claude "undercover": contribuições furtivas para código aberto

Talvez o detalhe técnico mais discutido seja o "Modo undercover". Este recurso revela que a Anthropic usa o Claude Code para contribuições "furtivas" em repositórios públicos de código aberto.

O prompt do sistema descoberto no vazamento avisa explicitamente o modelo:

"Você está operando UNDERCOVER... Suas mensagens de commit... NÃO DEVEM conter NENHUMA informação interna da Anthropic. Não estrague seu disfarce."

Embora a Anthropic possa usar isso para testes internos, a estrutura fornece um framework técnico para qualquer organização que deseje usar agentes de IA para trabalho voltado ao público sem divulgação. A lógica garante que nenhum nome de modelo ou atribuições de IA vazem para logs git públicos.

O que usuários e empresas devem fazer agora

Riscos de segurança imediatos

Embora o vazamento do código-fonte seja primariamente uma questão de propriedade intelectual, há riscos de segurança específicos para usuários:

Ataque à cadeia de suprimentos do axios

Horas antes do vazamento, ocorreu um ataque separado ao pacote axios do npm. Se você instalou ou atualizou o Claude Code via npm em 31 de março de 2026, entre 00h21 e 03h29 UTC, pode ter inadvertidamente instalado uma versão maliciosa:

axios 1.14.1 ou 0.30.4

Dependência

plain-crypto-js

Ações recomendadas:

Pesquise imediatamente seus arquivos de bloqueio (

package-lock.json,yarn.lockoubun.lockb)Se encontrar as versões comprometidas, trate a máquina como totalmente comprometida

Alterne todos os segredos e credenciais

Execute uma reinstalação limpa do sistema operacional

Mitigação de riscos futuros

Migre para o instalador nativo

A Anthropic designou o Instalador Nativo como o método recomendado:

curl -fsSL https://install.anthropic.com | bash

Vantagens do instalador nativo:

Binário independente que não depende da cadeia de dependência volátil do npm

Suporta atualizações automáticas em segundo plano

Patches de segurança aplicados imediatamente

Adote postura de confiança zero

Evite executar o agente em repositórios não confiáveis

Inspecione manualmente

.claude/config.jsone hooks personalizadosAlterne suas chaves de API Anthropic regularmente

Monitore o uso em busca de anomalias

Impacto no mercado de IA

Para o mercado mais amplo de inteligência artificial, o vazamento efetivamente nivela o campo de atuação para a orquestração de agentes. Os concorrentes agora podem estudar:

Mais de 2.500 linhas de lógica de validação bash

Estruturas de memória em camadas

Arquitetura de daemon autônomo

Sistemas de personalidade (como o "Buddy", um pet terminal estilo Tamagotchi)

Isso permite construir agentes "semelhantes a Claude" com uma fração do orçamento de P&D. À medida que os "projetos" do Claude Code saem do laboratório, a corrida para construir a próxima geração de agentes autônomos acaba de receber um impulso não planejado de US$ 2,5 bilhões em inteligência coletiva.

FAQ sobre o vazamento do Claude Code

O vazamento afeta meus dados na nuvem da Anthropic?

Não. O vazamento expõe o código-fonte do produto, não os dados dos usuários armazenados na nuvem. Seus dados permanecem seguros nos servidores da Anthropic.

Preciso parar de usar o Claude Code imediatamente?

Não necessariamente, mas você deve migrar para o instalador nativo e garantir que não está usando versões comprometidas do npm instaladas durante o período do ataque ao axios.

Como sei se fui afetado pelo ataque ao axios?

Verifique seus arquivos de bloqueio de dependências procurando pelas versões específicas mencionadas (1.14.1 ou 0.30.4) ou a dependência plain-crypto-js.

A Anthropic se pronunciou oficialmente sobre o vazamento?

Até o momento desta publicação, a Anthropic não emitiu uma declaração oficial sobre o incidente.

Esse vazamento beneficia ou prejudica o desenvolvimento de IA?

Ambos. Acelera a inovação ao disponibilizar técnicas avançadas para a comunidade, mas também expõe vulnerabilidades e reduz a vantagem competitiva da Anthropic em um mercado altamente competitivo.

O vazamento do Claude Code marca um momento decisivo na história da inteligência artificial comercial. Enquanto a Anthropic trabalha para conter os danos, a indústria de IA já está absorvendo e implementando os insights revelados. Para desenvolvedores e empresas, este incidente serve como um lembrete crucial sobre a importância da segurança da cadeia de suprimentos e da gestão adequada de propriedade intelectual em um ecossistema cada vez mais complexo.