- Data Hackers Newsletter

- Posts

- Sam Altman critica Claude Mythos: CEO da OpenAI acusa Anthropic de usar "marketing do medo"

Sam Altman critica Claude Mythos: CEO da OpenAI acusa Anthropic de usar "marketing do medo"

Gigantes da IA adotaram estratégias distintas em relação à cibersegurança, e CEO da OpenAI atacou modelo de concorrente

O mundo da inteligência artificial está novamente em polêmica. Desta vez, o CEO da OpenAI, Sam Altman, atacou publicamente a estratégia da Anthropic na divulgação do Claude Mythos, acusando a empresa rival de usar "marketing baseado no medo" para valorizar seu modelo mais recente.

O que é o Claude Mythos e por que é tão restrito?

O Claude Mythos é um dos modelos de IA mais recentes da Anthropic, anunciado no início de março de 2026. Diferentemente de outros lançamentos, este modelo foi disponibilizado apenas para empresas participantes do Projeto Glasswing - sob a justificativa de ser "perigoso demais" para o público geral.

Segundo a Anthropic, o Mythos foi treinado especificamente para ser altamente capaz em programação. No entanto, um efeito colateral desta capacidade é sua eficiência extraordinária em encontrar vulnerabilidades em softwares críticos, incluindo:

Sistemas operacionais

Navegadores web

Infraestrutura de segurança

Essa característica levou a empresa a adotar uma postura cautelosa, restringindo o acesso ao modelo apenas para clientes corporativos de alto valor.

A crítica de Sam Altman

Durante uma participação no podcast Core Memory, Altman não poupou palavras ao criticar a abordagem da Anthropic. Segundo o CEO da OpenAI, a empresa rival estaria usando o medo como ferramenta de marketing para elevar artificialmente o valor do Claude Mythos.

"Há pessoas no mundo que, há muito tempo, desejam manter a IA nas mãos de um grupo menor de pessoas", declarou Altman. Ele continuou com uma metáfora provocativa: "É claramente uma estratégia de marketing incrível dizer: 'Construímos uma bomba e estamos prestes a jogá-la na sua cabeça. Vamos vender um abrigo antibombas para você por US$ 100 milhões'".

A declaração de Altman sugere que a Anthropic estaria exagerando os riscos do Claude Mythos como forma de justificar seu alto preço e acesso restrito, criando uma narrativa de exclusividade baseada no medo.

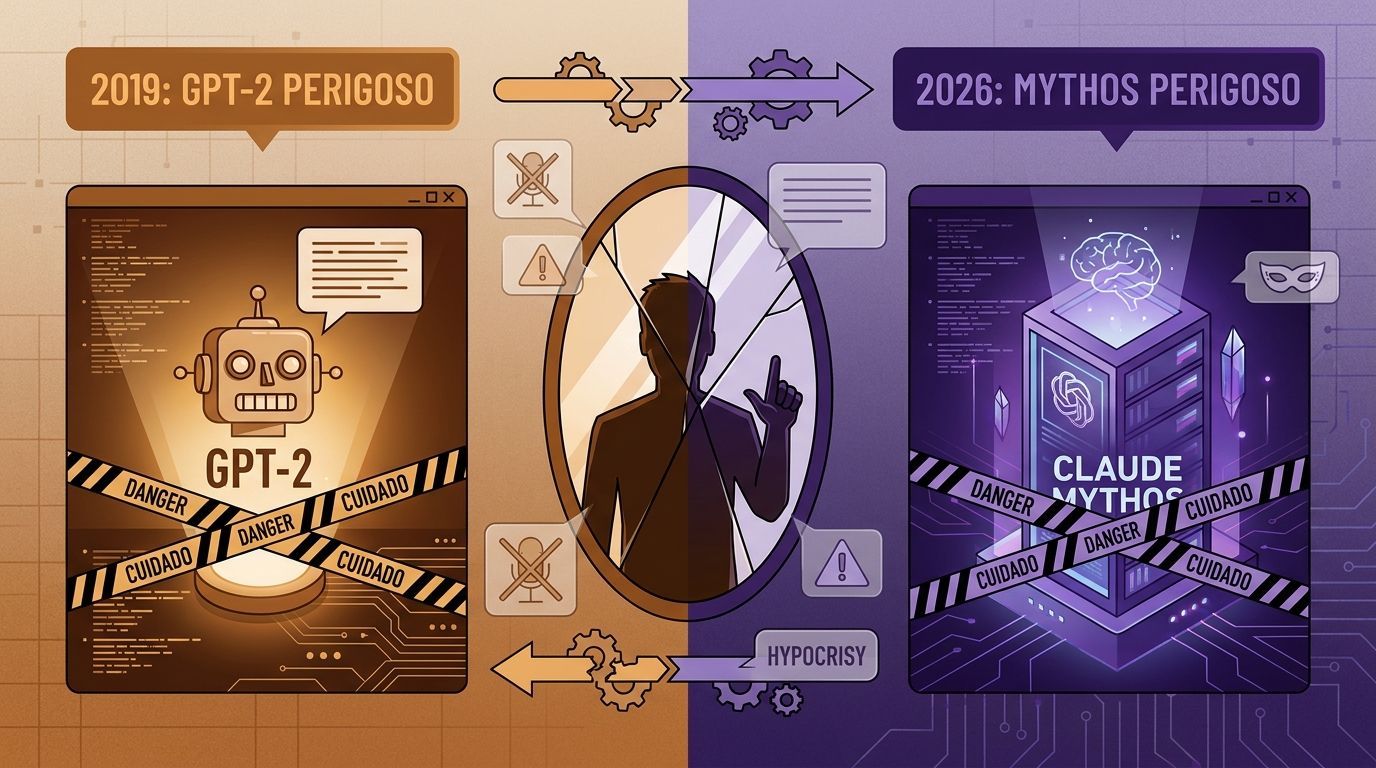

A hipocrisia da OpenAI: quando a empresa fez o mesmo

O que torna as críticas de Sam Altman particularmente interessantes é o histórico da própria OpenAI com estratégias similares. Em 2019, a empresa afirmou que o GPT-2 era "perigoso demais" para ser liberado integralmente ao público.

Na época, a OpenAI justificou a decisão alegando que o modelo seria capaz de gerar textos extremamente convincentes com facilidade, o que poderia ser usado para:

Desinformação em massa

Criação de fake news sofisticadas

Manipulação de opinião pública

As consequências da decisão de 2019

A decisão de não liberar o GPT-2 completo rendeu críticas significativas da comunidade de IA, que acusou a OpenAI de trair os princípios de abertura que justificavam seu nome. A empresa acabou disponibilizando apenas uma versão reduzida do modelo.

Ironicamente, atualmente a família de modelos da OpenAI já está na versão GPT-5, significativamente mais poderosa que o GPT-2 - e amplamente disponível para o público. Isso levanta questões sobre se os riscos alegados em 2019 eram reais ou também faziam parte de uma estratégia de marketing.

As declarações alarmistas de Altman sobre IA

Além do episódio do GPT-2, Sam Altman é conhecido por fazer declarações públicas alarmistas sobre o impacto da inteligência artificial na sociedade. Entre suas afirmações mais notáveis estão:

40% das tarefas da economia global: Altman já afirmou que a IA pode assumir até 40% das tarefas da economia mundial

Risco existencial: O executivo declarou que a tecnologia de IA representa um risco existencial para a humanidade

Essas declarações levantam a questão: seria Altman igualmente culpado de usar "marketing do medo" para promover seus produtos e visão de futuro?

A batalha entre OpenAI e Anthropic

Esta não é a primeira vez que as duas empresas se enfrentam publicamente. A rivalidade entre OpenAI e Anthropic é bem documentada, especialmente considerando que a Anthropic foi fundada por ex-funcionários da OpenAI que deixaram a empresa devido a divergências sobre direção e segurança.

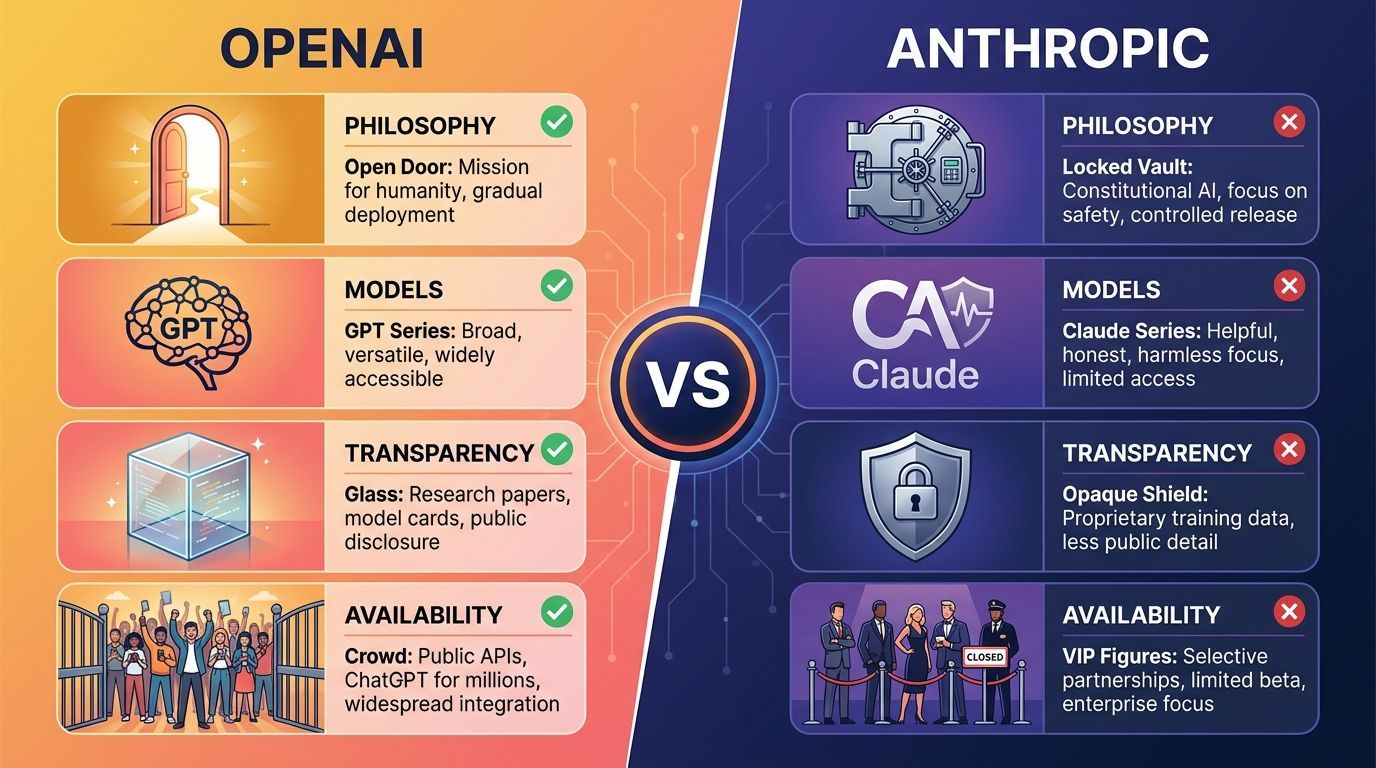

Principais diferenças entre as empresas

Aspecto | OpenAI | Anthropic |

|---|---|---|

Filosofia | Acesso amplo com cautela | Acesso restrito com foco em segurança |

Modelos principais | GPT-4, GPT-5 | Claude, Claude Mythos |

Transparência | Moderada | Alta em pesquisa de segurança |

Disponibilidade | Ampla (com versões pagas) | Seletiva para modelos avançados |

O debate sobre segurança em IA

A polêmica em torno do Claude Mythos e as críticas de Sam Altman levantam questões fundamentais sobre como a indústria de IA deve lidar com modelos potencialmente perigosos:

Argumentos a favor da restrição

Modelos muito capazes em encontrar vulnerabilidades podem ser usados por agentes maliciosos

A liberação gradual permite avaliar riscos em ambiente controlado

Empresas têm responsabilidade social de prevenir uso indevido

Argumentos contra a restrição

Restrições podem criar monopólios de conhecimento

A comunidade de segurança precisa de acesso para identificar e corrigir vulnerabilidades

"Marketing do medo" pode ser usado para justificar preços inflacionados

FAQ sobre o Claude Mythos e a polêmica

O que torna o Claude Mythos tão perigoso?

Sua capacidade excepcional em encontrar vulnerabilidades em softwares críticos, incluindo sistemas operacionais e navegadores, que poderia ser explorada por hackers.

A OpenAI já usou estratégia similar à da Anthropic?

Sim. Em 2019, a OpenAI manteve o GPT-2 restrito alegando que era perigoso demais, uma decisão que gerou críticas similares às que Altman faz agora à Anthropic.

Quem tem acesso ao Claude Mythos atualmente?

Apenas empresas participantes do Projeto Glasswing da Anthropic, um programa exclusivo para clientes corporativos de alto valor.

As críticas de Sam Altman são justificadas?

Há argumentos dos dois lados. Enquanto alguns veem hipocrisia nas declarações de Altman dado o histórico da OpenAI, outros concordam que a Anthropic pode estar usando o medo como ferramenta de marketing.

Conclusão: marketing ou responsabilidade real?

A polêmica entre Sam Altman e a Anthropic sobre o Claude Mythos ilustra um dilema fundamental da indústria de IA: onde termina a responsabilidade corporativa e começa o marketing estratégico?

Enquanto a Anthropic argumenta que mantém o Mythos restrito por questões legítimas de segurança, Altman sugere que isso seria apenas uma desculpa para elevar o valor percebido do modelo. Por outro lado, o próprio histórico da OpenAI com o GPT-2 e as declarações alarmistas de Altman sobre IA sugerem que ambas as empresas podem estar jogando o mesmo jogo.

O que fica claro é que, à medida que os modelos de IA se tornam mais poderosos, a tensão entre abertura, segurança e interesses comerciais continuará gerando debates acalorados na indústria.

A questão permanece: essas empresas estão realmente preocupadas com a segurança da humanidade, ou estão apenas usando o medo como ferramenta de marketing para valorizar seus produtos? Talvez a resposta esteja em algum lugar no meio.