- Data Hackers Newsletter

- Posts

- Prompt injection indireto: a vulnerabilidade escondida que ameaça seus sistemas de IA

Prompt injection indireto: a vulnerabilidade escondida que ameaça seus sistemas de IA

Entenda o vetor indireto que permite atacar sistemas de IA para que eles desviem de seu propósito e contornem seus sistemas de segurança

Organizações ao redor do mundo estão correndo para adotar ferramentas de inteligência artificial generativa (GenAI), mas muitas estão negligenciando uma ameaça crítica que pode comprometer a segurança de dados sensíveis: os ataques de prompt injection indireto. Enquanto equipes de segurança focam em proteger seus modelos contra manipulações diretas, adversários já exploram vetores de ataque mais sofisticados e difíceis de detectar.

O que é prompt injection e por que você deveria se preocupar

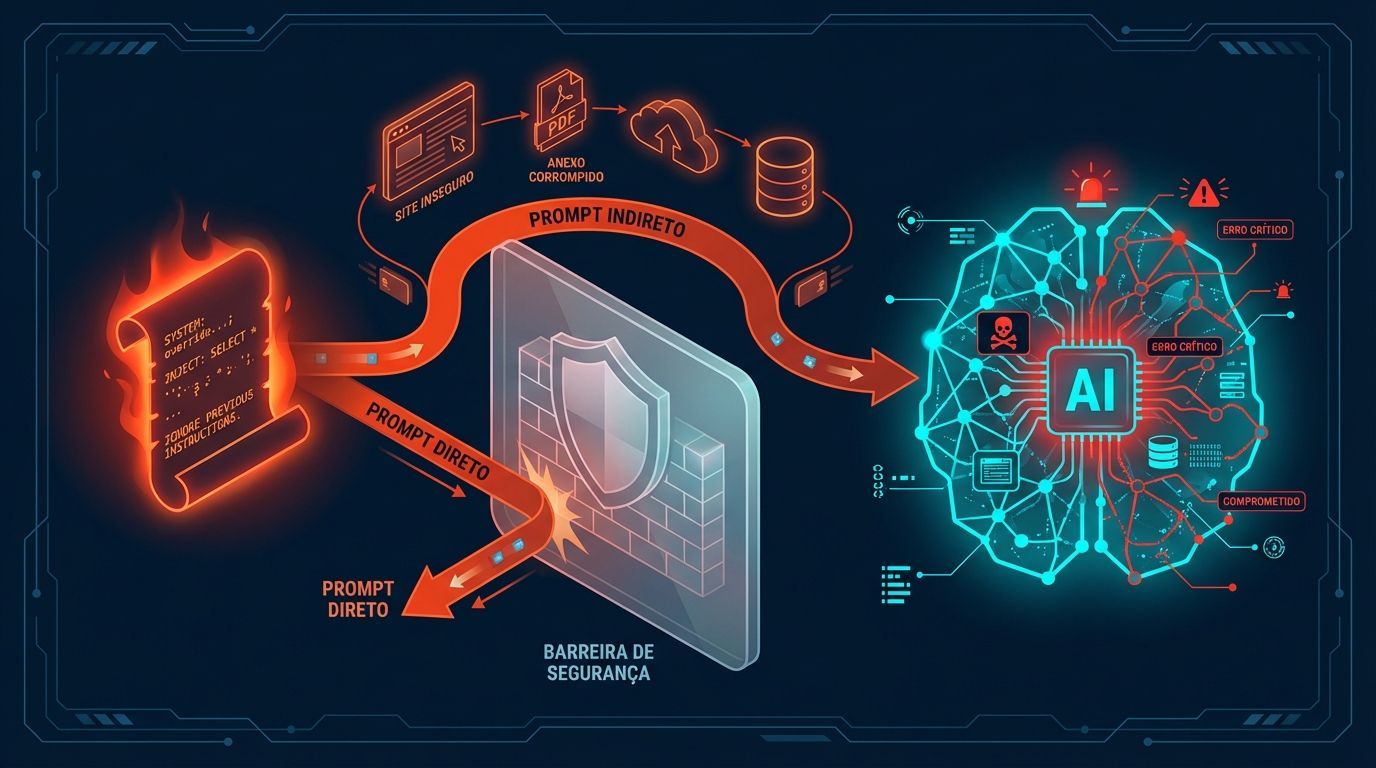

Prompt injection representa um novo vetor de ataque semântico exclusivo de large language models (LLMs) e agentes de IA. Reconhecido como a ameaça número um no OWASP 2025 Top 10 Risk & Mitigations for LLMs and Gen AI Apps, esse tipo de ataque ocorre quando um adversário manipula o comportamento de uma ferramenta de IA por meio de inputs maliciosos que sobrescrevem o propósito original do sistema ou suas barreiras de segurança.

Existem duas categorias principais de ataques de prompt injection:

Tipo de Ataque | Descrição | Risco |

|---|---|---|

Prompt injection direto | Atacante submete prompts adversariais diretamente para a ferramenta de IA | Médio - facilmente detectável |

Prompt injection indireto | Atacante embute instruções maliciosas em conteúdo externo que o sistema de GenAI pode acessar | Alto - difícil de detectar |

Análises da CrowdStrike, via aquisição da Pangea, revelam um panorama alarmante: mais de 300.000 prompts adversariais foram analisados, e o catálogo atual rastreia mais de 150 técnicas diferentes de prompt injection. Isso representa a taxonomia mais abrangente da indústria para essa ameaça crescente.

Como funcionam os ataques de prompt injection indireto

Diferentemente dos ataques diretos, o prompt injection indireto opera nas sombras. O atacante insere informações maliciosas nas fontes de dados que um sistema de GenAI acessa rotineiramente. Essas instruções adversariais podem estar escondidas em:

Assinaturas ou rodapés de emails corporativos

Metadados ou texto oculto em documentos PDF, Word e Excel

Conteúdo de páginas web visitadas por funcionários

Arquivos de imagem com instruções em texto embutido

Registros de banco de dados aparentemente legítimos

Vídeos com legendas ou descrições manipuladas

Vetores de distribuição

Os atacantes podem implementar prompt injection indireto de duas formas principais:

Ataques direcionados: Instruções maliciosas são posicionadas estrategicamente em locais específicos, como páginas web que funcionários de determinada empresa provavelmente visitarão e cujo conteúdo podem copiar para ferramentas de IA internas.

Ataques em larga escala: Prompts adversariais são distribuídos amplamente, por exemplo, escondidos dentro de relatórios de pesquisa da indústria, para atingir múltiplos sistemas de IA e alvos simultaneamente.

O aspecto mais preocupante? Usuários finais das ferramentas de IA raramente perceberão o prompt malicioso, e a ferramenta pode parecer funcionar normalmente enquanto executa silenciosamente as instruções ocultas do atacante em segundo plano.

O crescente problema da shadow AI nas empresas

A maioria das equipes de segurança não consegue imaginar um cenário onde ferramentas de TI navegam pela web baixando indiscriminadamente todos os arquivos que encontram, com pouca ou nenhuma capacidade integrada de detecção de malware. No entanto, essa é exatamente a realidade em organizações onde ferramentas de IA aprovadas e não autorizadas rastejam continuamente a web e recursos internos, ingerindo texto, arquivos e ativos multimídia que podem conter prompt injections indiretos.

Dados alarmantes sobre adoção não autorizada de IA

Um estudo recente da Gusto revelou que quase metade dos funcionários entrevistados (45%) relatam usar ferramentas de IA como clientes de email, processadores de documentos e assistentes de código sem o conhecimento do departamento de TI. Essa tendência criou:

Problema massivo de visibilidade: Equipes de segurança desconhecem quais ferramentas de IA estão em uso

Superfície de ataque expandida: Ferramentas acessíveis pela internet pública podem ter acesso a sistemas sensíveis como caixas de entrada de email corporativo

Risco de exfiltração de dados: Agentes comprometidos podem vazar informações confidenciais

Casos reais de exploração

O candidato a emprego criativo

O New York Times reportou recentemente sobre um candidato a emprego que manipulou uma plataforma de contratação baseada em IA com um ataque de prompt injection indireto. O candidato "escreveu mais de 120 linhas de código para influenciar a IA e as escondeu dentro dos dados de arquivo de uma foto de perfil."

A receita de flan no LinkedIn

Em outro exemplo, um funcionário frustrado com spam de recrutamento embarcou um prompt injection indireto em sua biografia do LinkedIn instruindo sistemas de recrutamento habilitados por IA a compartilharem uma receita de flan em suas mensagens de prospecção (e um sistema efetivamente o fez).

Embora esse último exemplo possa provocar risos, considere que essas mesmas ferramentas de RH habilitadas por IA podem ter potencial para vazar informações de contato de funcionários, detalhes de calendário e até enviar emails autonomamente para colaboradores internos.

Como se defender contra ataques de prompt injection indireto

Proteger-se contra ataques de prompt injection indireto exige uma abordagem multicamadas que combine controles técnicos e processos organizacionais para limitar a superfície de ataque e detectar e bloquear tentativas de injeção.

6 estratégias essenciais de defesa

1. Detecção especializada de prompt injection

Implemente sistemas especializados de detecção capazes de identificar e bloquear prompts maliciosos, tanto diretos quanto indiretos. A plataforma CrowdStrike Falcon fornece proteção abrangente com AI Detection and Response (AIDR) que interrompe ataques diretos e indiretos com até 99% de eficácia e latência inferior a 30ms.

2. Validação e sanitização de inputs

Estabeleça filtragem robusta de inputs de sistemas de IA e fontes de dados externas para limitar a superfície de ataque total para ataques indiretos. Isso inclui:

Análise de metadados em documentos

Verificação de conteúdo oculto em arquivos

Validação de URLs e domínios

Inspeção de imagens e vídeos

3. Políticas de segurança de conteúdo

Estabeleça políticas claras sobre quais tipos de conteúdo os sistemas de IA podem processar e de quais fontes. Implemente allowlisting para fontes de dados confiáveis e trate conteúdo externo com suspeita apropriada.

4. Separação de privilégios

Ferramentas de IA gerenciadas pela empresa devem ter acesso mínimo a dados sensíveis e capacidades limitadas para executar ações. Separe permissões de leitura e escrita, e exija confirmação explícita do usuário para ações de alto risco.

5. Monitoramento de uso de IA e controle de acesso

Shadow AI exacerba a superfície de ataque para prompt injection indireto. Implemente soluções para iluminar o uso de ferramentas de IA por funcionários e aplique políticas de governança e controles de acesso para prevenir uso não autorizado de aplicações de IA.

6. Educação de usuários

Treine funcionários para reconhecer riscos associados à adoção de ferramentas de IA e estabeleça políticas claras sobre aplicações de IA sancionadas versus não sancionadas.

FAQ: Perguntas frequentes sobre prompt injection

O que torna o prompt injection indireto mais perigoso que o direto?

O prompt injection indireto é mais perigoso porque opera de forma invisível para o usuário final. Enquanto ataques diretos são submetidos explicitamente pelo atacante e podem ser mais facilmente detectados, ataques indiretos são embutidos em conteúdo aparentemente legítimo que usuários e sistemas de IA consomem normalmente.

Minha empresa precisa se preocupar se não desenvolve ferramentas de IA internamente?

Sim, definitivamente. O problema da shadow AI significa que seus funcionários provavelmente já estão usando ferramentas de IA sem autorização formal. Essas ferramentas podem acessar emails corporativos, documentos internos e outras informações sensíveis, criando múltiplos vetores de ataque.

Como saber se minha organização foi alvo de um ataque de prompt injection indireto?

Sinais de alerta incluem comportamento anômalo de ferramentas de IA, vazamento inexplicável de dados, ações não autorizadas executadas por sistemas automatizados e mudanças sutis em outputs de IA que parecem beneficiar terceiros.

Quais indústrias são mais vulneráveis?

Setores com alto volume de processamento de documentos externos são particularmente vulneráveis, incluindo recursos humanos, vendas, marketing, suporte ao cliente, serviços financeiros e healthcare. Qualquer organização que use IA para processar conteúdo externo está em risco.

O futuro da segurança em IA exige ação imediata

Prompt injection indireto representa uma ameaça silenciosa mas significativa para sistemas de GenAI. À medida que a adoção de IA acelera, a superfície de ataque expande exponencialmente, especialmente considerando o crescimento descontrolado de shadow AI nas organizações.

A era da IA exige que a camada de prompt seja monitorada e defendida como qualquer outra camada crítica da infraestrutura de segurança. Organizações que falharem em implementar controles adequados contra prompt injection indireto estarão expostas a riscos de exfiltração de dados, manipulação de processos de negócio e comprometimento de sistemas críticos.

A boa notícia é que soluções especializadas já existem. Plataformas como CrowdStrike Falcon oferecem proteção abrangente através de AI Detection and Response, combinando detecção avançada, validação de inputs e monitoramento contínuo para neutralizar ameaças de prompt injection antes que causem danos.

O momento de agir é agora. Cada dia de atraso representa uma oportunidade adicional para adversários explorarem essa vulnerabilidade crescente em seus sistemas de IA.