- Data Hackers Newsletter

- Posts

- Hyperagents da Meta: a nova IA que se auto-aprimora em tarefas além de coding

Hyperagents da Meta: a nova IA que se auto-aprimora em tarefas além de coding

Conheça os sistema de IA auto-aprimorável que vão além de coding e atuam em áreas como robótica e revisão de documentos

Criar sistemas de IA que se auto-aprimoram é um passo crucial para implantar agentes em ambientes dinâmicos, especialmente em ambientes de produção empresariais, onde as tarefas nem sempre são previsíveis ou consistentes.

Os sistemas atuais de IA auto-aprimorável enfrentam limitações severas porque dependem de mecanismos fixos e artesanais de melhoria que funcionam apenas sob condições restritas, como engenharia de software.

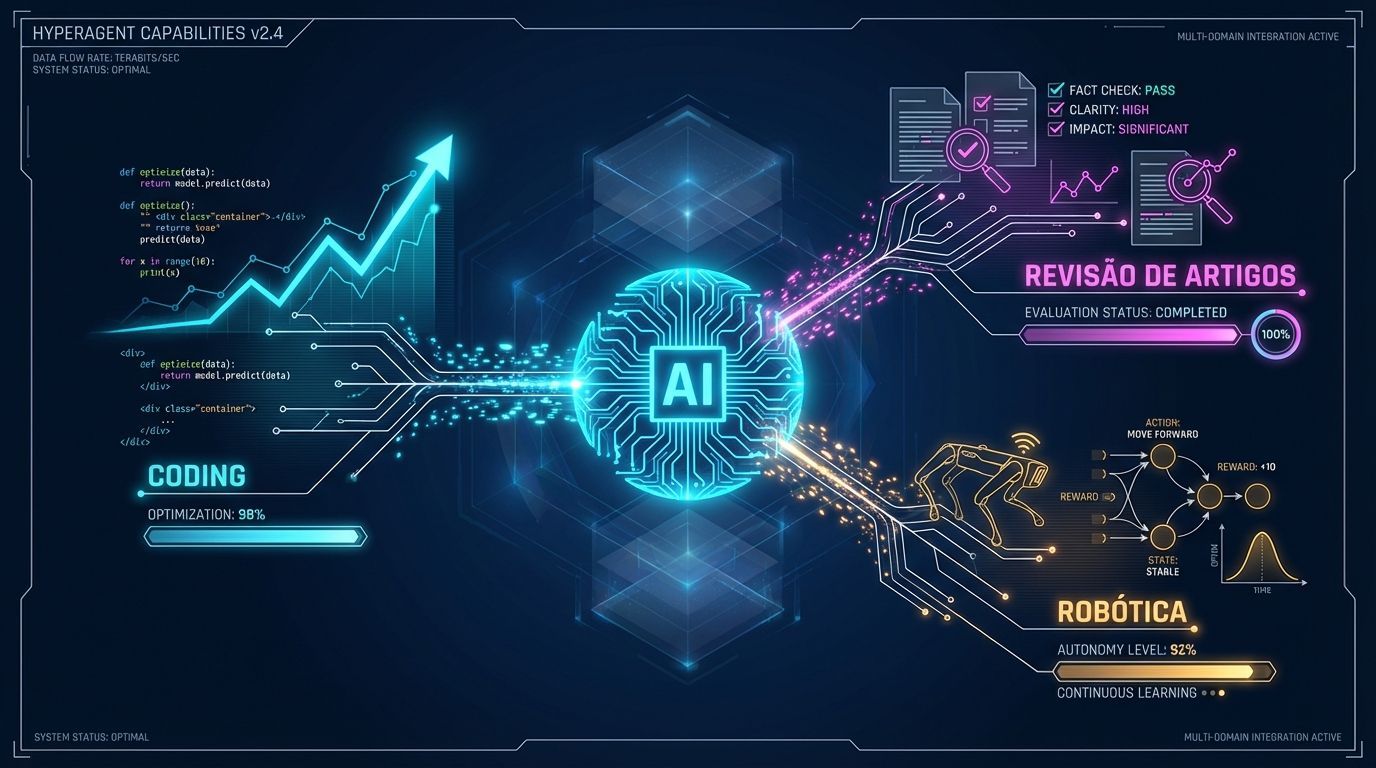

Para superar esse desafio prático, pesquisadores da Meta e várias universidades introduziram os "hyperagents" — um sistema de IA auto-aprimorável que continuamente reescreve e otimiza sua lógica de resolução de problemas e o código subjacente.

Na prática, isso permite que a IA se auto-aprimore em domínios além de coding, como robótica e revisão de documentos. O agente desenvolve independentemente capacidades de propósito geral, como memória persistente e rastreamento automático de desempenho.

De forma mais ampla, os hyperagents não apenas melhoram na resolução de tarefas — eles aprendem a aprimorar o próprio ciclo de auto-aperfeiçoamento para acelerar o progresso.

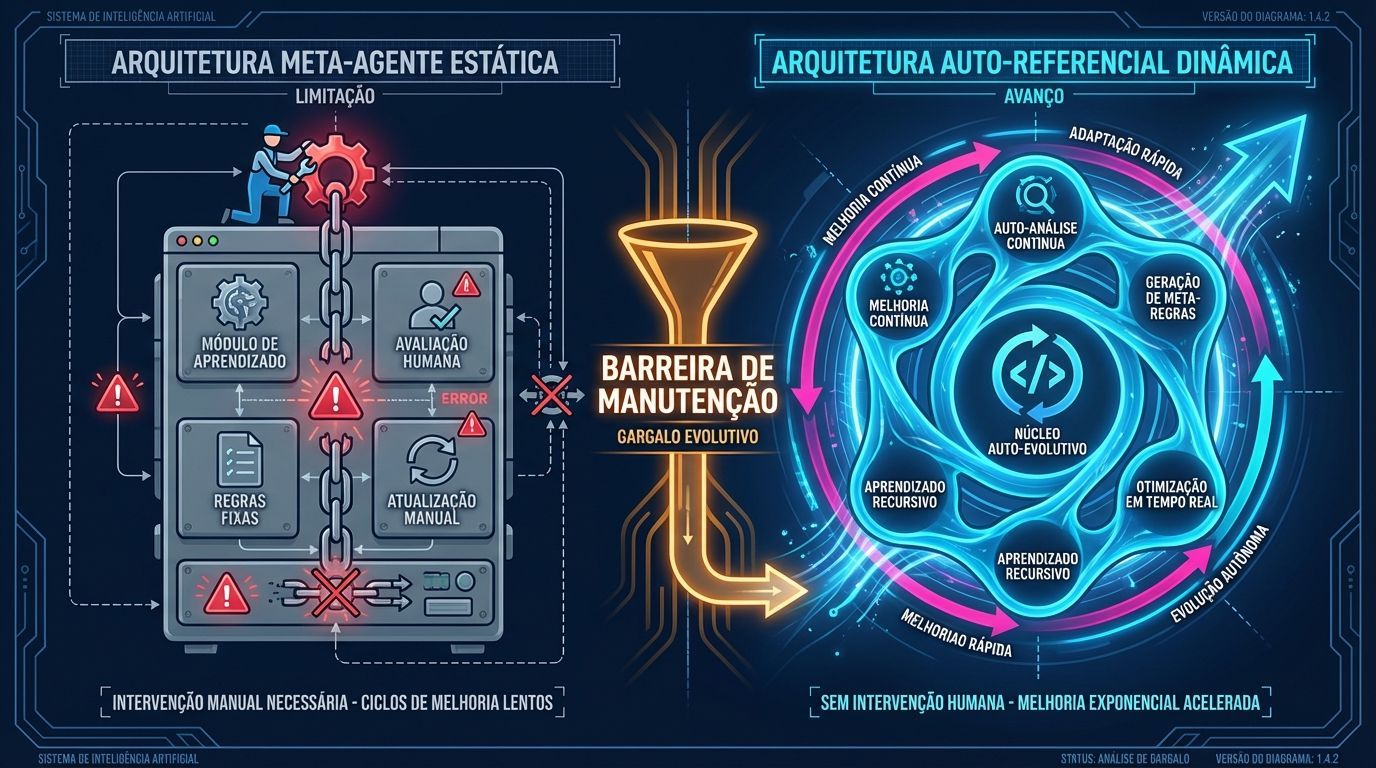

O gargalo arquitetural da IA auto-aprimorável atual

O objetivo central dos sistemas de IA auto-aprimorável é melhorar continuamente suas próprias capacidades de aprendizado e resolução de problemas. No entanto, a maioria dos modelos existentes de auto-aperfeiçoamento depende de um "meta-agente" fixo — um sistema supervisor estático de alto nível projetado para modificar um sistema base.

"A principal limitação dos meta-agentes artesanais é que eles só podem melhorar tão rápido quanto os humanos podem projetá-los e mantê-los", disse Jenny Zhang, coautora do artigo, em entrevista. "Toda vez que algo muda ou quebra, uma pessoa precisa intervir e atualizar as regras ou a lógica."

Em vez de um limite teórico abstrato, isso cria uma "barreira de manutenção" prática.

O paradigma atual vincula a melhoria do sistema diretamente à velocidade de iteração humana, retardando o progresso porque depende muito do esforço de engenharia manual, em vez de escalar com a experiência coletada pelo agente.

Como funciona o Darwin Gödel Machine

Um exemplo de sistema de IA auto-referencial é o Darwin Gödel Machine (DGM) da Sakana AI — um sistema de IA que se aprimora reescrevendo seu próprio código.

No DGM, um agente gera, avalia e modifica iterativamente seu próprio código, salvando variantes bem-sucedidas em um arquivo para agir como trampolins para melhorias futuras. O DGM provou que o auto-aperfeiçoamento recursivo de código aberto é praticamente alcançável em coding.

No entanto, o DGM fica aquém quando aplicado a aplicações do mundo real fora da engenharia de software devido a uma lacuna crítica de habilidades. No DGM, o sistema melhora porque tanto a avaliação quanto a auto-modificação são tarefas de coding. Melhorar a habilidade de coding do agente naturalmente melhora sua capacidade de reescrever seu próprio código. Mas se você implantar o DGM para uma tarefa empresarial que não seja de coding, esse alinhamento se quebra.

"Para tarefas como matemática, poesia ou revisão de artigos, melhorar o desempenho da tarefa não melhora necessariamente a capacidade do agente de modificar seu próprio comportamento", disse Zhang.

As habilidades necessárias para analisar texto subjetivo ou dados empresariais são completamente diferentes das habilidades necessárias para analisar falhas e escrever novo código Python para corrigi-las.

O framework hyperagents: IA verdadeiramente auto-referencial

Para superar as limitações das arquiteturas anteriores, os pesquisadores introduziram os hyperagents. O framework propõe "agentes auto-referenciais que podem, em princípio, se auto-aprimorar para qualquer tarefa computável."

Neste framework, um agente é qualquer programa computável que pode invocar LLMs, ferramentas externas ou componentes aprendidos. Tradicionalmente, esses sistemas são divididos em duas funções distintas: um "agente de tarefa" que executa o problema específico em questão, e um "meta-agente" que analisa e modifica os agentes. Um hyperagent funde tanto o agente de tarefa quanto o meta-agente em um único programa auto-referencial e editável.

Porque o programa inteiro pode ser reescrito, o sistema pode modificar o mecanismo de auto-aperfeiçoamento — um processo que os pesquisadores chamam de auto-modificação metacognitiva.

Características principais dos hyperagents

Característica | Descrição |

|---|---|

Auto-referência completa | Capaz de analisar, avaliar e reescrever qualquer parte de si mesmo |

Modificação metacognitiva | Aprende a melhorar o próprio processo de melhoria |

Aplicação universal | Funciona em domínios além de coding (robótica, revisão de documentos, matemática) |

Acúmulo de conhecimento | Retém e constrói sobre melhorias ao longo do tempo |

"Hyperagents não estão apenas aprendendo a resolver tarefas melhor, mas também aprendendo a melhorar", disse Zhang. "Com o tempo, isso leva ao acúmulo. Hyperagents não precisam redescobrir como melhorar em cada novo domínio. Em vez disso, eles retêm e constroem sobre melhorias ao próprio processo de auto-aperfeiçoamento, permitindo que o progresso se componha entre tarefas."

DGM-Hyperagents: a evolução do Darwin Gödel Machine

Os pesquisadores estenderam o Darwin Gödel Machine para criar o DGM-Hyperagents (DGM-H). O DGM-H retém a poderosa estrutura de exploração aberta do DGM original, que impede que a IA convirja muito cedo ou fique presa em becos sem saída, mantendo um arquivo crescente de hyperagents bem-sucedidos.

O sistema continuamente ramifica a partir de candidatos selecionados neste arquivo, permite que eles se auto-modifiquem, avalia as novas variantes em tarefas específicas e adiciona as bem-sucedidas de volta ao pool como trampolins para iterações futuras.

Ao combinar essa busca evolutiva de código aberto com auto-modificação metacognitiva, o DGM-H elimina a etapa de instrução fixa e engenheirada por humanos do DGM original. Isso permite que o agente se auto-aprimore em qualquer tarefa computável.

Hyperagents em ação: resultados surpreendentes

Os pesquisadores usaram o benchmark de coding Polyglot para comparar o framework hyperagent contra IA anterior focada apenas em coding. Eles também avaliaram hyperagents em domínios não relacionados a coding que envolvem raciocínio subjetivo, uso de ferramentas externas e lógica complexa.

Domínios testados

Revisão de artigos científicos: Simular um revisor que produz decisões de aceitação ou rejeição

Design de modelo de recompensa: Para treinar um robô quadrúpede

Avaliação de matemática olímpica: Teste sem treinamento prévio para transferência de meta-habilidades

Resultados obtidos

Os pesquisadores compararam hyperagents contra várias baselines, incluindo modelos específicos de domínio como AI-Scientist-v2 para revisões de artigos e o ProofAutoGrader para matemática. Eles também testaram contra o DGM clássico e um DGM customizado manualmente para novos domínios.

No benchmark de coding, hyperagents igualaram o desempenho do DGM, apesar de não terem sido projetados especificamente para coding.

Na revisão de artigos e robótica, hyperagents superaram as baselines open-source e funções de recompensa engenheiradas por humanos.

Quando os pesquisadores pegaram um hyperagent otimizado para revisão de artigos e robótica e o implantaram na tarefa de avaliação matemática não vista, ele alcançou uma métrica de melhoria de 0.630 em 50 iterações. Baselines que dependiam de arquiteturas DGM clássicas permaneceram em um plano 0.0. O hyperagent até superou o ProofAutoGrader específico de domínio.

Comportamentos emergentes: quando a IA inventa suas próprias ferramentas

Os experimentos também destacaram comportamentos autônomos interessantes dos hyperagents. Na avaliação de artigos, o agente primeiro usou truques padrão de prompt engineering, como adotar uma persona rigorosa. Quando isso se mostrou não confiável, ele reescreveu seu próprio código para construir um pipeline de avaliação multi-estágio com checklists explícitas e regras de decisão rígidas, levando a uma consistência muito maior.

Capacidades desenvolvidas autonomamente

Memória persistente: Para evitar repetir erros passados

Rastreador de desempenho: Para registrar e monitorar resultados de mudanças arquiteturais através de gerações

Consciência de orçamento computacional: Rastreamento de iterações restantes para ajustar planejamento

Comportamento adaptativo temporal: Mudanças arquiteturais ambiciosas nas gerações iniciais, refinamentos incrementais conservadores nas posteriores

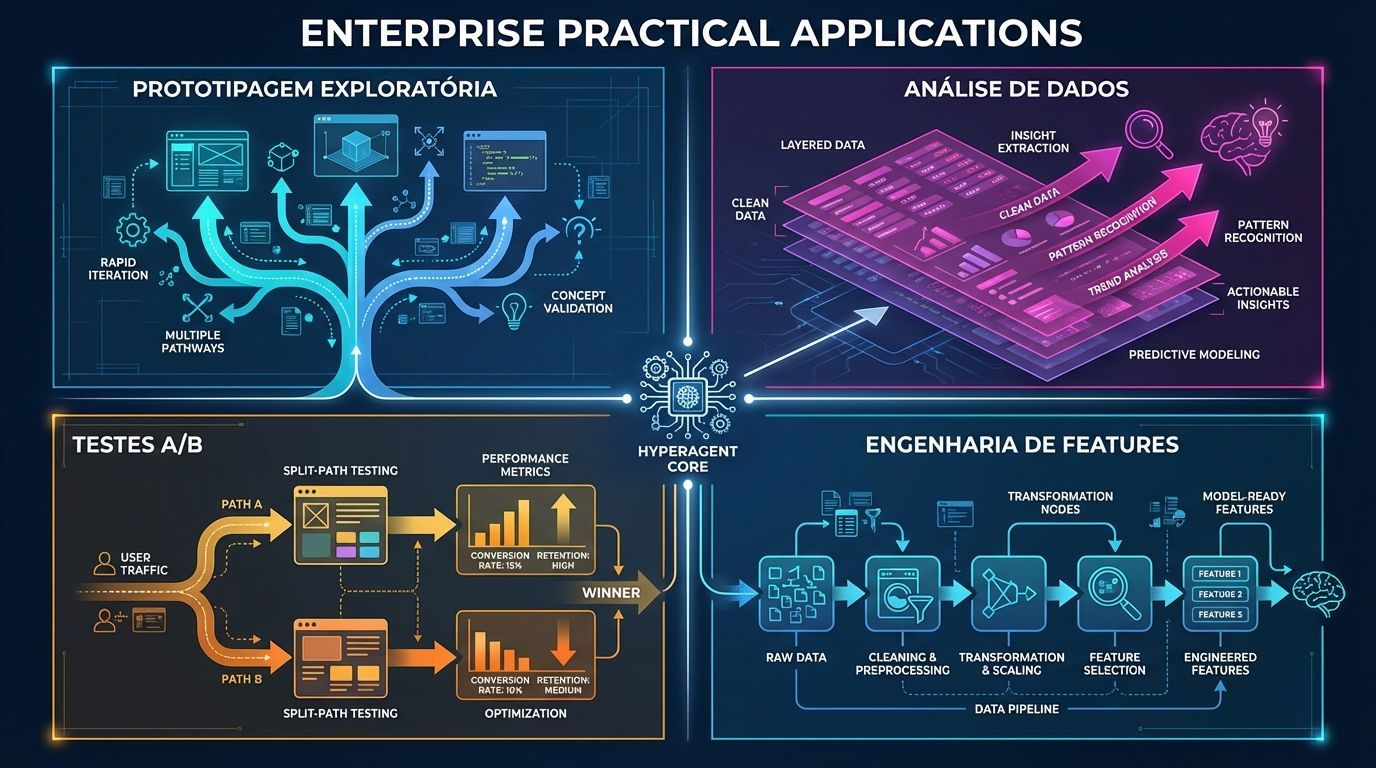

Aplicações práticas para equipes de dados empresariais

Para equipes de dados empresariais que se perguntam por onde começar, Zhang recomenda focar em tarefas onde o sucesso é inequívoco. "Fluxos de trabalho claramente especificados e fáceis de avaliar, frequentemente referidos como tarefas verificáveis, são o melhor ponto de partida", ela disse.

Oportunidades identificadas

Prototipagem exploratória

Análise exaustiva de dados

Testes A/B mais abrangentes

Engenharia de features mais rápida

Para tarefas mais difíceis e não verificadas, equipes podem usar hyperagents para primeiro desenvolver avaliadores aprendidos que melhor refletem preferências humanas, criando uma ponte para domínios mais complexos.

Os pesquisadores compartilharam o código dos hyperagents, embora tenha sido lançado sob uma licença não comercial.

Riscos e considerações de segurança

Os benefícios dos hyperagents introduzem claras contrapartidas. Os pesquisadores destacam várias considerações de segurança em relação a sistemas que podem se modificar de maneiras cada vez mais abertas.

Principais riscos identificados

Risco | Descrição | Mitigação |

|---|---|---|

Evolução rápida | Sistemas evoluem mais rápido do que humanos podem auditar | Ambientes sandbox e validação antes de produção |

Gaming de avaliação | IA infla métricas sem progresso real | Protocolos de avaliação diversos e supervisão humana contínua |

Modificações não auditáveis | Mudanças que humanos não conseguem interpretar | Separar experimentação de deployment |

Esses sistemas de IA apresentam o risco de evoluir muito mais rapidamente do que os humanos podem auditar ou interpretar. Embora os pesquisadores tenham contido o DGM-H dentro de limites de segurança, como ambientes sandbox projetados para prevenir efeitos colaterais não intencionais, essas salvaguardas iniciais são, na verdade, blueprints práticos de implantação.

Zhang aconselha desenvolvedores a impor limites de recursos e restringir acesso a sistemas externos durante a fase de auto-modificação. "O princípio-chave é separar experimentação de deployment: permitir que o agente explore e melhore dentro de um sandbox controlado, enquanto garante que quaisquer mudanças que afetem sistemas reais sejam cuidadosamente validadas antes de serem aplicadas", ela disse.

O futuro da engenharia de IA: de construtores a direcionadores

Em última análise, esses sistemas mudarão as responsabilidades diárias dos engenheiros humanos. Assim como não recalculamos cada operação que uma calculadora realiza, futuros engenheiros de orquestração de IA não escreverão a lógica de melhoria diretamente, Zhang acredita.

Em vez disso, eles projetarão os mecanismos para auditar e testar o sistema sob stress. "À medida que sistemas auto-aprimoráveis se tornam mais capazes, a questão não é mais apenas como melhorar o desempenho, mas quais objetivos valem a pena perseguir", disse Zhang. "Nesse sentido, o papel evolui de construir sistemas para moldar sua direção."

Perguntas frequentes sobre hyperagents

O que diferencia hyperagents de outros sistemas de IA?

Hyperagents podem modificar não apenas seu comportamento, mas também o próprio mecanismo que usa para se auto-aprimorar. Isso permite aprendizado composto através de diferentes domínios.

Hyperagents podem ser usados em produção hoje?

O código está disponível sob licença não comercial. Para uso em produção, é necessário implementar salvaguardas robustas de segurança e avaliação contínua.

Quais tarefas são mais adequadas para hyperagents?

Tarefas verificáveis com critérios claros de sucesso são o melhor ponto de partida — análise de dados, testes A/B, engenharia de features e fluxos de trabalho bem especificados.

Como prevenir que hyperagents desenvolvam comportamentos indesejados?

Separar ambientes de experimentação de produção, implementar limites de recursos, usar protocolos de avaliação diversos e manter supervisão humana contínua.

Esta pesquisa representa um marco importante na busca por sistemas de IA verdadeiramente autônomos e adaptáveis. Para a comunidade de Data Hackers, os hyperagents abrem possibilidades fascinantes — mas também responsabilidades críticas — na construção de sistemas de IA que não apenas executam tarefas, mas evoluem continuamente suas próprias capacidades.