- Data Hackers Newsletter

- Posts

- Grammarly na justiça: jornalista processa empresa por uso indevido de IA que clonava identidades sem permissão

Grammarly na justiça: jornalista processa empresa por uso indevido de IA que clonava identidades sem permissão

Entenda imbróglio judicial envolvendo assistente de IA voltado para escrita de textos

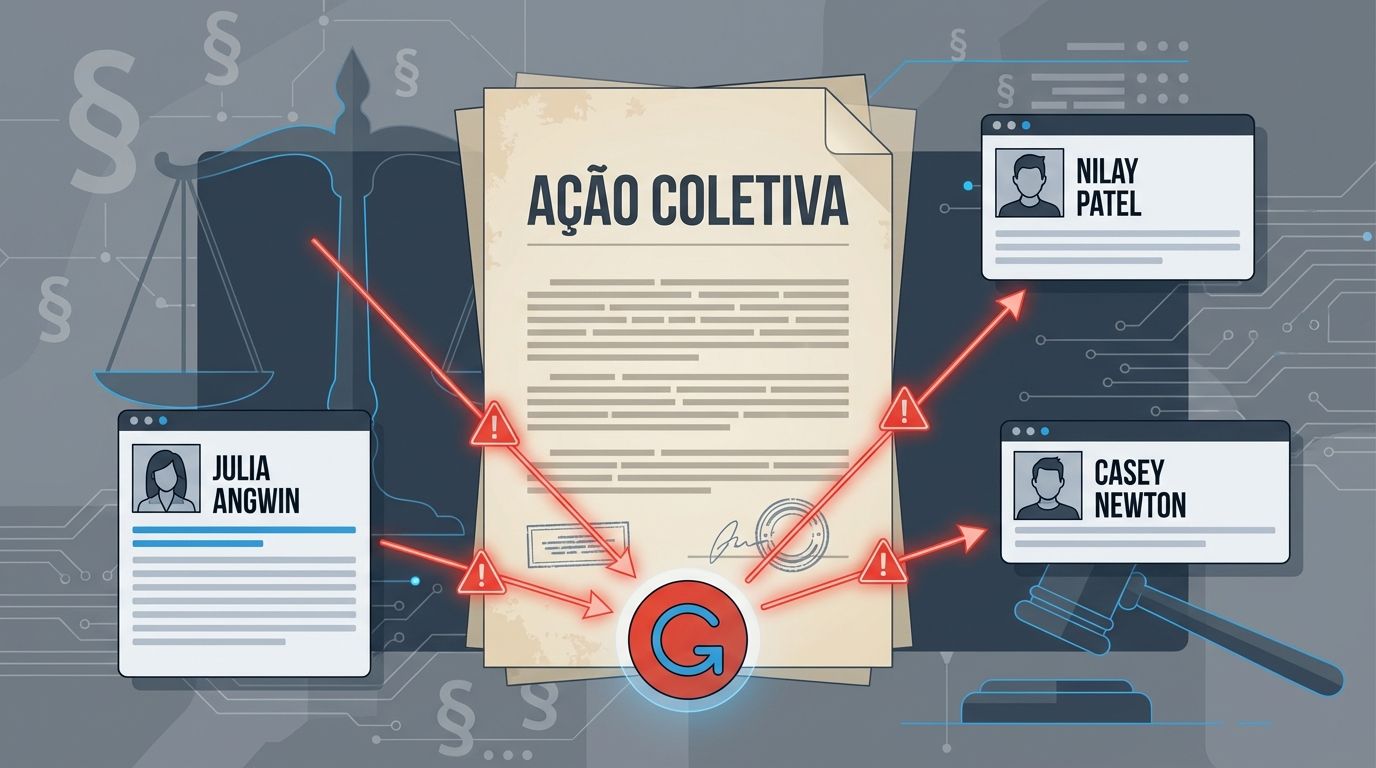

A inteligência artificial continua gerando polêmicas no mundo da tecnologia, e desta vez o Grammarly está no centro de uma controvérsia significativa. A jornalista Julia Angwin entrou com uma ação coletiva contra a empresa depois de descobrir que sua identidade foi utilizada sem autorização no recurso de IA "Expert Review" da plataforma.

O que é o recurso Expert Review do Grammarly

O Grammarly, conhecido mundialmente como uma ferramenta de correção gramatical e aprimoramento de escrita, lançou recentemente um recurso de IA chamado "Expert Review". A proposta era ambiciosa: oferecer sugestões de edição baseadas em "especialistas" reais, conectando usuários com perspectivas influentes e trabalhos acadêmicos relevantes.

O problema? A empresa utilizou nomes, fotos e identidades de jornalistas, escritores e acadêmicos reais sem obter qualquer tipo de consentimento prévio. Entre os afetados estão:

Julia Angwin (jornalista investigativa)

Nilay Patel (editor-chefe do The Verge)

Casey Newton (jornalista de tecnologia)

Diversos membros da equipe do The Verge

A ação judicial contra o Grammarly

A queixa de ação coletiva apresentada por Julia Angwin na última quarta-feira alega que a Superhuman (empresa por trás do Grammarly) violou direitos de privacidade e publicidade dos "especialistas". Segundo o processo, a empresa infringiu leis que proíbem o uso da identidade de alguém para fins comerciais sem consentimento.

Como Julia Angwin descobriu o uso indevido

A jornalista soube que sua identidade estava sendo utilizada através de Casey Newton, outro jornalista que também apareceu como "especialista" no sistema. A descoberta aconteceu quando o The Verge testou o recurso e encontrou vários de seus próprios funcionários sendo apresentados como fontes de sugestões de IA.

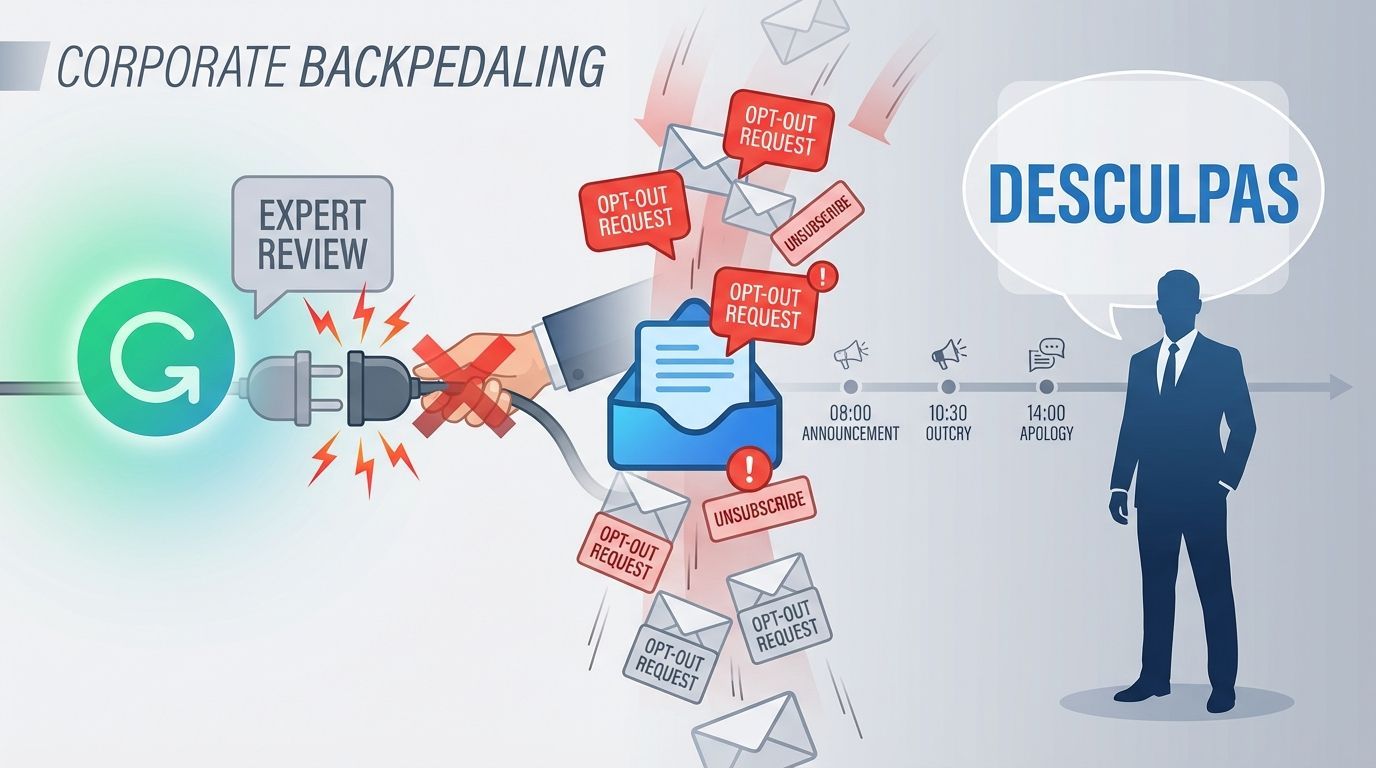

A resposta do Grammarly à controvérsia

Diante da repercussão negativa e da ação judicial, o Grammarly tomou algumas medidas:

Desativação imediata do recurso

Na mesma quarta-feira em que o processo foi protocolado, a empresa anunciou a desativação do recurso Expert Review. A decisão veio após uma semana turbulenta, na qual a empresa havia inicialmente criado apenas uma caixa de entrada de e-mail onde escritores e acadêmicos poderiam solicitar a exclusão de suas identidades do sistema.

Pedido público de desculpas

O CEO Shishir Mehrotra divulgou um comunicado reconhecendo o erro:

"O agente foi projetado para ajudar os usuários a descobrir perspectivas influentes e trabalhos acadêmicos relevantes ao seu trabalho, além de fornecer maneiras significativas para os especialistas construírem relacionamentos mais profundos com seus fãs. Ouvimos o feedback e reconhecemos que falhamos neste aspecto. Quero pedir desculpas e reconhecer que repensaremos nossa abordagem no futuro."

Implicações para o futuro da IA

Este caso levanta questões importantes sobre o desenvolvimento e implementação de tecnologias de inteligência artificial:

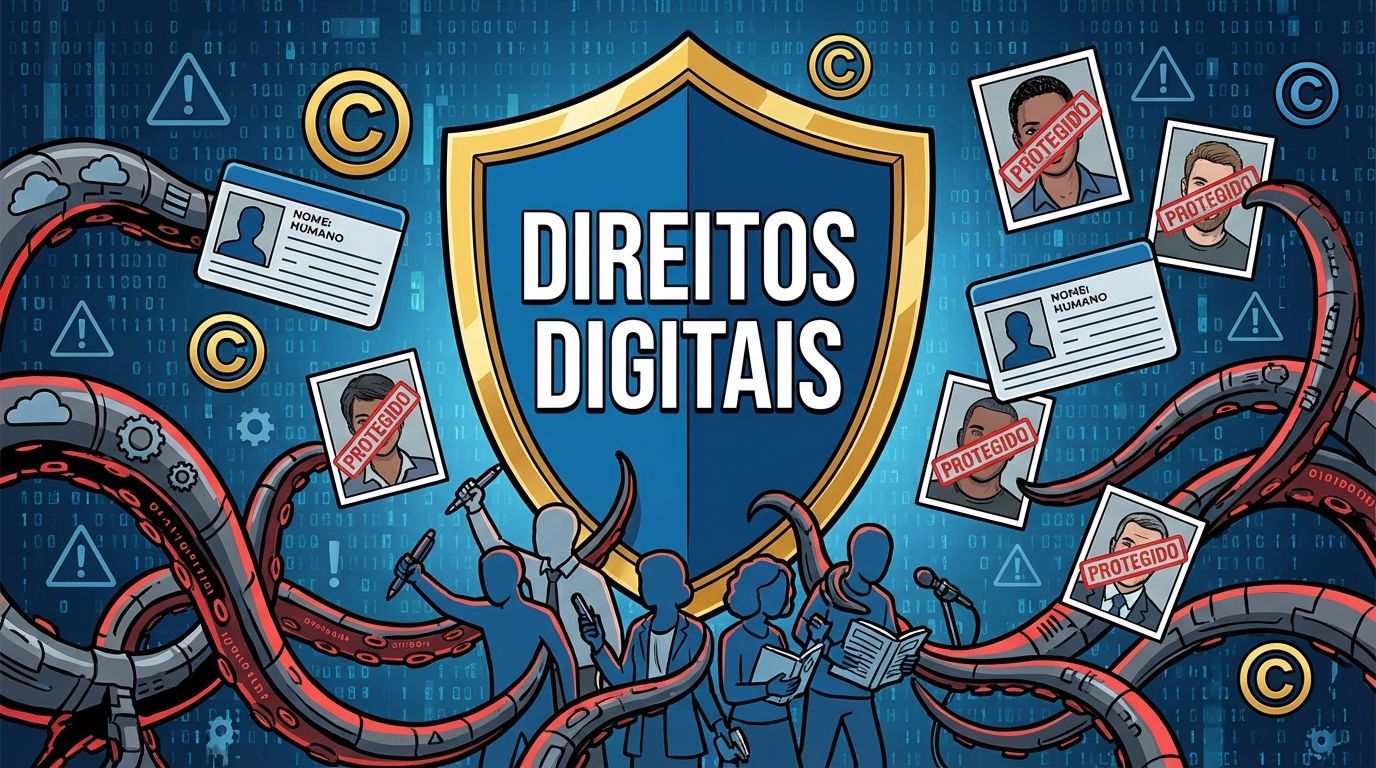

Direitos de imagem na era digital

A situação do Grammarly exemplifica um problema crescente: empresas de tecnologia utilizando dados e identidades de pessoas reais para treinar e alimentar sistemas de IA sem consentimento adequado. Isso cria precedentes legais importantes para casos futuros.

Transparência no desenvolvimento de IA

A falta de transparência do Grammarly sobre como o recurso Expert Review funcionava e quem seriam os "especialistas" demonstra uma falha crítica na comunicação com o público e com as pessoas diretamente afetadas.

O que isso significa para usuários e criadores de conteúdo

Para profissionais que produzem conteúdo online, este caso serve como alerta:

Suas identidades e trabalhos podem ser utilizados sem permissão

É fundamental acompanhar como empresas de IA estão usando dados públicos

Pode ser necessário buscar proteção legal preventiva

A transparência das empresas de tecnologia precisa ser cobrada

Perguntas frequentes sobre o caso Grammarly

O Grammarly ainda está usando o recurso Expert Review?

Não. A empresa desativou completamente o recurso após a ação judicial e as críticas públicas.

Quem pode participar da ação coletiva?

Qualquer pessoa cuja identidade foi utilizada sem autorização no recurso Expert Review do Grammarly pode potencialmente se juntar à ação coletiva.

Como saber se minha identidade foi utilizada?

Atualmente, com o recurso desativado, não há uma forma direta de verificar. Se você é um escritor, jornalista ou acadêmico com presença online significativa, pode ter sido afetado.

O que outras empresas de IA podem aprender com este caso?

A importância de obter consentimento explícito antes de usar identidades, imagens ou trabalhos de pessoas reais em recursos de IA, além da necessidade de transparência total sobre como os sistemas funcionam.

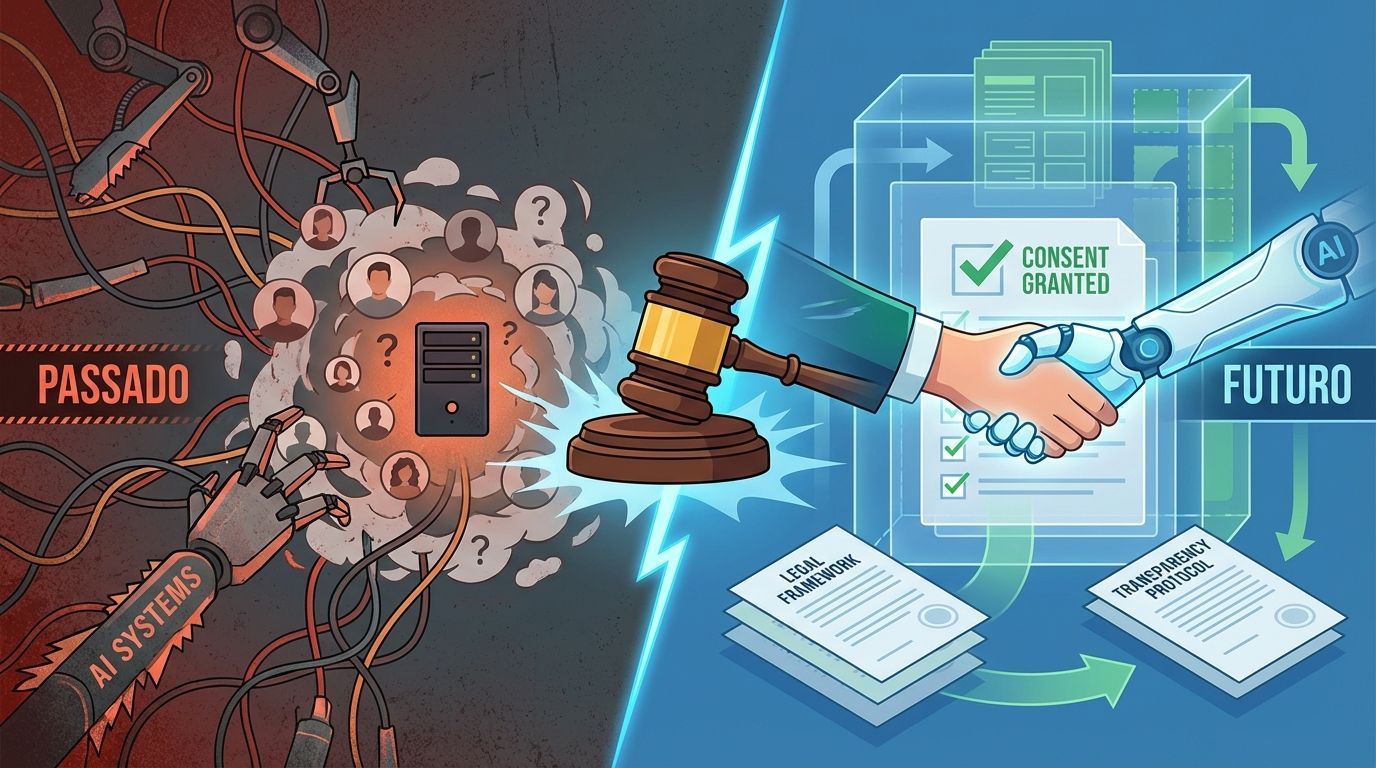

O precedente para outras empresas de IA

O caso do Grammarly não é isolado. Várias empresas de inteligência artificial têm enfrentado processos similares relacionados ao uso indevido de dados e identidades. Este processo específico pode estabelecer precedentes importantes para:

Definição clara de consentimento no contexto de IA

Limites legais para uso comercial de identidades públicas

Responsabilidade corporativa no desenvolvimento de recursos de IA

Proteções mais robustas para criadores de conteúdo

Conclusão

A ação judicial contra o Grammarly representa um momento crucial na interseção entre inteligência artificial, direitos de privacidade e ética corporativa. Enquanto as empresas correm para implementar recursos inovadores de IA, casos como este demonstram a necessidade urgente de frameworks legais e éticos mais robustos.

Para os profissionais de tecnologia, desenvolvedores de IA e empresas do setor, a lição é clara: inovação sem consentimento e transparência pode resultar em consequências legais significativas e danos irreparáveis à reputação. O futuro da IA depende não apenas de avanços técnicos, mas também de práticas responsáveis e respeito aos direitos individuais.

À medida que este caso se desenrola nos tribunais, todos no ecossistema de tecnologia estarão observando atentamente. O resultado pode moldar fundamentalmente como empresas de IA operam e como dados pessoais são protegidos na era da inteligência artificial.