- Data Hackers Newsletter

- Posts

- Conheça técnicas para diminuir alucinação em agentes de IA

Conheça técnicas para diminuir alucinação em agentes de IA

Entenda como evitar alucinações e garantir que seu modelo entregue outputs mais confiáveis e precisos

Mesmo os modelos de linguagem mais avançados, como o Claude, podem ocasionalmente gerar textos que são factualmente incorretos ou inconsistentes com o contexto fornecido. Esse fenômeno, conhecido como "alucinação", pode comprometer a confiabilidade das suas soluções baseadas em IA. Neste guia, vamos explorar técnicas práticas para minimizar alucinações e garantir que os outputs dos seus agentes de IA sejam precisos e confiáveis.

O que são alucinações em modelos de IA?

Alucinação em IA refere-se à tendência dos modelos de linguagem de gerar informações que parecem plausíveis, mas são factualmente incorretas ou não têm base no contexto fornecido. Isso pode variar desde pequenas imprecisões até afirmações completamente fabricadas.

Para equipes de data science e desenvolvedores que trabalham com aplicações críticas, entender como mitigar esse problema é essencial para construir sistemas de IA confiáveis e auditáveis.

Estratégias básicas para minimizar alucinações

Permita que o modelo admita incerteza

Uma das técnicas mais simples e eficazes é dar permissão explícita para que o modelo admita quando não sabe algo. Essa abordagem pode reduzir drasticamente a geração de informações falsas.

Exemplo: Analisando um relatório de fusões e aquisições

Analise este relatório de M&A e responda às seguintes perguntas.

Se você não encontrar informações suficientes no documento para responder

com confiança, diga "Não há informações suficientes no documento fornecido

para responder a esta pergunta" em vez de especular.

Relatório: [inserir documento]

Perguntas:

1. Qual foi o valor total da aquisição?

2. Quais foram as principais sinergias identificadas?

3. Qual é o prazo estimado para conclusão?

Use citações diretas para fundamentação factual

Para tarefas envolvendo documentos longos (>20K tokens), peça ao modelo para extrair citações palavra por palavra antes de realizar sua tarefa. Isso ancora as respostas no texto real, reduzindo significativamente as alucinações.

Exemplo: Auditando uma política de privacidade de dados

Primeiro, extraia as citações relevantes deste documento de política de

privacidade que abordam cada um dos seguintes pontos:

1. Retenção de dados

2. Direitos do usuário

3. Compartilhamento com terceiros

Depois, com base apenas nessas citações, resuma as principais políticas

para cada categoria.

Documento: [inserir política de privacidade]

Verifique com citações e fontes

Torne as respostas do modelo auditáveis fazendo com que ele cite quotes e fontes para cada uma de suas afirmações. Você também pode pedir que o modelo verifique cada afirmação encontrando uma citação de apoio após gerar uma resposta. Se não conseguir encontrar uma citação, deve retratar a afirmação.

Exemplo: Redigindo um press release sobre lançamento de produto

Redija um press release sobre nosso novo produto com base nas seguintes

informações do produto. Para cada afirmação factual que você fizer,

inclua uma citação entre [colchetes] do material fonte.

Se você precisar fazer uma afirmação mas não encontrar uma citação de

apoio, marque-a com [VERIFICAÇÃO NECESSÁRIA] e liste-a no final.

Informações do produto: [inserir especificações e detalhes]

Técnicas avançadas para desenvolvedores

Chain-of-thought verification

Peça ao modelo para explicar seu raciocínio passo a passo antes de dar uma resposta final. Isso pode revelar lógica falha ou suposições incorretas.

# Exemplo de implementação

prompt = """

Analise a seguinte questão e explique seu raciocínio passo a passo:

Questão: {question}

Contexto: {context}

Passo 1: Identifique as informações-chave no contexto

Passo 2: Relacione essas informações com a questão

Passo 3: Tire uma conclusão baseada apenas nessas informações

Passo 4: Forneça sua resposta final

Se em qualquer passo você não tiver informações suficientes,

indique isso claramente.

"""

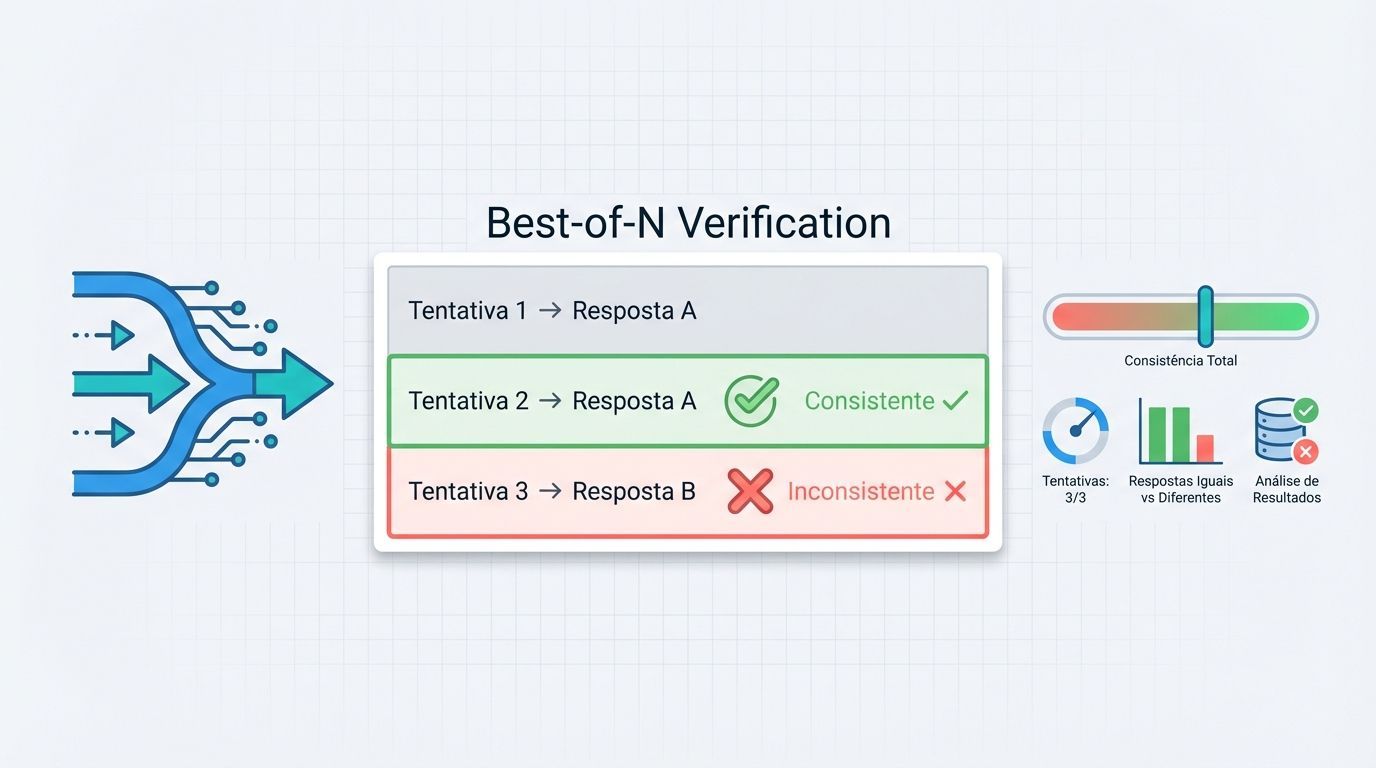

Best-of-N verification

Execute o modelo várias vezes com o mesmo prompt e compare os outputs. Inconsistências entre as respostas podem indicar alucinações.

Tentativa | Resposta | Status |

|---|---|---|

1 | Resposta A | - |

2 | Resposta A | Consistente ✓ |

3 | Resposta B | Inconsistente ✗ |

Se houver divergências significativas, isso sinaliza a necessidade de refinamento do prompt ou verificação adicional.

Refinamento iterativo

Use os outputs do modelo como inputs para prompts de acompanhamento, pedindo que ele verifique ou expanda declarações anteriores. Isso pode capturar e corrigir inconsistências.

Prompt 1: Gere um resumo do documento

Output 1: [resumo gerado]

Prompt 2: Revise o resumo anterior e verifique se cada afirmação

pode ser encontrada no documento original. Liste quaisquer afirmações

que não podem ser verificadas.

Restrição de conhecimento externo

Instrua explicitamente o modelo a usar apenas informações de documentos fornecidos e não seu conhecimento geral.

IMPORTANTE: Responda APENAS com base nas informações contidas neste documento.

Não use conhecimento geral ou informações externas. Se a informação não

estiver no documento, diga claramente "Esta informação não está presente

no documento fornecido".

Documento: [texto]

Pergunta: [pergunta]

Checklist de implementação

Para implementar essas técnicas em seus projetos, considere:

[ ] Adicionar instruções explícitas permitindo que o modelo admita incerteza

[ ] Implementar sistema de citações para respostas auditáveis

[ ] Criar pipeline de verificação iterativa para outputs críticos

[ ] Configurar testes automatizados com Best-of-N verification

[ ] Estabelecer processo de revisão humana para decisões de alto impacto

[ ] Documentar casos de uso específicos onde cada técnica é mais eficaz

Considerações finais

Embora essas técnicas reduzam significativamente as alucinações, elas não as eliminam completamente. Para aplicações em produção, especialmente aquelas envolvendo decisões críticas, sempre valide informações importantes através de:

Revisão humana especializada

Verificação cruzada com múltiplas fontes

Sistemas de auditoria e logging

Testes contínuos e monitoramento de qualidade

A combinação dessas estratégias técnicas com boas práticas de engenharia de software e processos de validação robustos é fundamental para construir sistemas de IA confiáveis e prontos para produção.

Perguntas frequentes

Como saber se meu modelo está alucinando?

Procure por inconsistências entre múltiplas execuções, afirmações sem citações do contexto fornecido, ou informações que parecem muito específicas sem fonte clara.

Qual técnica devo usar primeiro?

Comece permitindo que o modelo admita incerteza e exigindo citações. Essas são as técnicas mais simples e com melhor custo-benefício.

Essas técnicas aumentam o custo de API?

Sim, algumas técnicas como Best-of-N verification e refinamento iterativo aumentam o número de chamadas à API. Avalie o trade-off entre custo e precisão para seu caso de uso específico.

Posso automatizar essas verificações?

Sim, todas essas técnicas podem ser implementadas programaticamente em seus pipelines de ML. Considere criar wrappers e funções auxiliares para facilitar a reutilização.