- Data Hackers Newsletter

- Posts

- Claude está mais fraco? Usuários relatam queda de performance e Anthropic nega degradação do modelo

Claude está mais fraco? Usuários relatam queda de performance e Anthropic nega degradação do modelo

Leia as acusações feitas pelos usuários e veja o que a empresa tem alegado em sua defesa

Desenvolvedores e usuários avançados de IA estão cada vez mais vocais nas redes sociais, acusando a Anthropic de degradar intencionalmente a performance do Claude Opus 4.6 e do Claude Code. As reclamações giram em torno de três pontos principais: o modelo parece menos capaz, menos confiável e mais desperdiçador de tokens do que há algumas semanas atrás.

As queixas se espalharam rapidamente pelo GitHub, X (antigo Twitter) e Reddit nas últimas semanas. Diversos posts de alto alcance alegam que o Claude piorou em raciocínio sustentado, está mais propenso a abandonar tarefas no meio do caminho e apresenta mais alucinações ou contradições.

O conceito de "AI shrinkflation" ganha força

Alguns usuários começaram a enquadrar a situação como "AI shrinkflation" — a ideia de que os clientes estão pagando o mesmo preço por um produto mais fraco. Outros foram ainda mais longe, sugerindo que a Anthropic pode estar limitando ou ajustando o Claude para baixo durante períodos de alta demanda.

Essas alegações permanecem sem comprovação definitiva, e funcionários da Anthropic negaram publicamente que a empresa degrada seus modelos para gerenciar capacidade. Ao mesmo tempo, a Anthropic reconheceu mudanças reais nos limites de uso e configurações padrão de raciocínio nas últimas semanas, o que tornou o debate ainda mais explosivo.

A Data Hackers entrou em contato com a Anthropic para esclarecimentos adicionais sobre as acusações recentes, mas a empresa não respondeu individualmente às questões. Em vez disso, nos direcionou para posts no X feitos por Boris Cherny, criador do Claude Code, e Thariq Shihipar, membro da equipe Claude Code.

Reclamações virais incluem análise técnica de diretora sênior da AMD

Uma das reclamações públicas mais detalhadas originou-se de uma issue no GitHub registrada por Stella Laurenzo em 2 de abril de 2026. Segundo seu perfil no LinkedIn, ela é Diretora Sênior no grupo de IA da AMD.

Naquela postagem, Laurenzo escreveu que o Claude Code havia regredido a ponto de não poder mais ser confiável para trabalhos de engenharia complexos. Ela então sustentou essa afirmação com uma análise extensa de 6.852 arquivos de sessão do Claude Code, 17.871 blocos de raciocínio (thinking blocks) e 234.760 chamadas de ferramentas.

A reclamação argumentou que, a partir de fevereiro, a profundidade estimada de raciocínio do Claude caiu drasticamente, enquanto sinais de performance inferior aumentaram. Entre os problemas identificados:

Mais paradas prematuras

Mais comportamento de "correção mais simples" (simplest fix)

Mais loops de raciocínio

Mudança mensurável de comportamento "pesquisa primeiro" para "edição primeiro"

O ponto central da postagem foi que, para fluxos de trabalho avançados de engenharia, o raciocínio estendido não é um luxo, mas parte do que torna o modelo utilizável em primeiro lugar.

Essa thread do GitHub escapou para a conversa mais ampla nas redes sociais quando usuários do X, incluindo @Hesamation, postaram capturas de tela da análise de Laurenzo em 11 de abril, transformando-a em um ponto de discussão ainda mais viral.

A resposta oficial da Anthropic: mudanças de produto, não degradação do modelo

A resposta pública da Anthropic focou em separar mudanças percebidas da degradação real do modelo. Em uma resposta fixada na mesma issue do GitHub postada há uma semana, Boris Cherny, líder do Claude Code, agradeceu a Laurenzo pelo cuidado e profundidade da análise, mas contestou sua conclusão principal.

Cherny disse que o cabeçalho "redact-thinking-2026-02-12" citado na reclamação é uma mudança apenas de interface que oculta o raciocínio da interface e reduz a latência, mas "não impacta o raciocínio em si", os "orçamentos de raciocínio" ou como o raciocínio estendido funciona internamente.

Ele também mencionou duas outras mudanças de produto que provavelmente afetaram o que os usuários estavam vendo:

A mudança do Opus 4.6 para adaptive thinking (raciocínio adaptativo) como padrão em 9 de fevereiro

Uma mudança em 3 de março para medium effort (esforço médio), ou nível de esforço 85, como padrão para o Opus 4.6

Cherny acrescentou que usuários que desejam mais raciocínio estendido podem mudar manualmente o esforço para mais alto digitando /effort high nas sessões de terminal do Claude Code.

Posts sobre benchmarks transformaram frustração anedótica em controvérsia pública

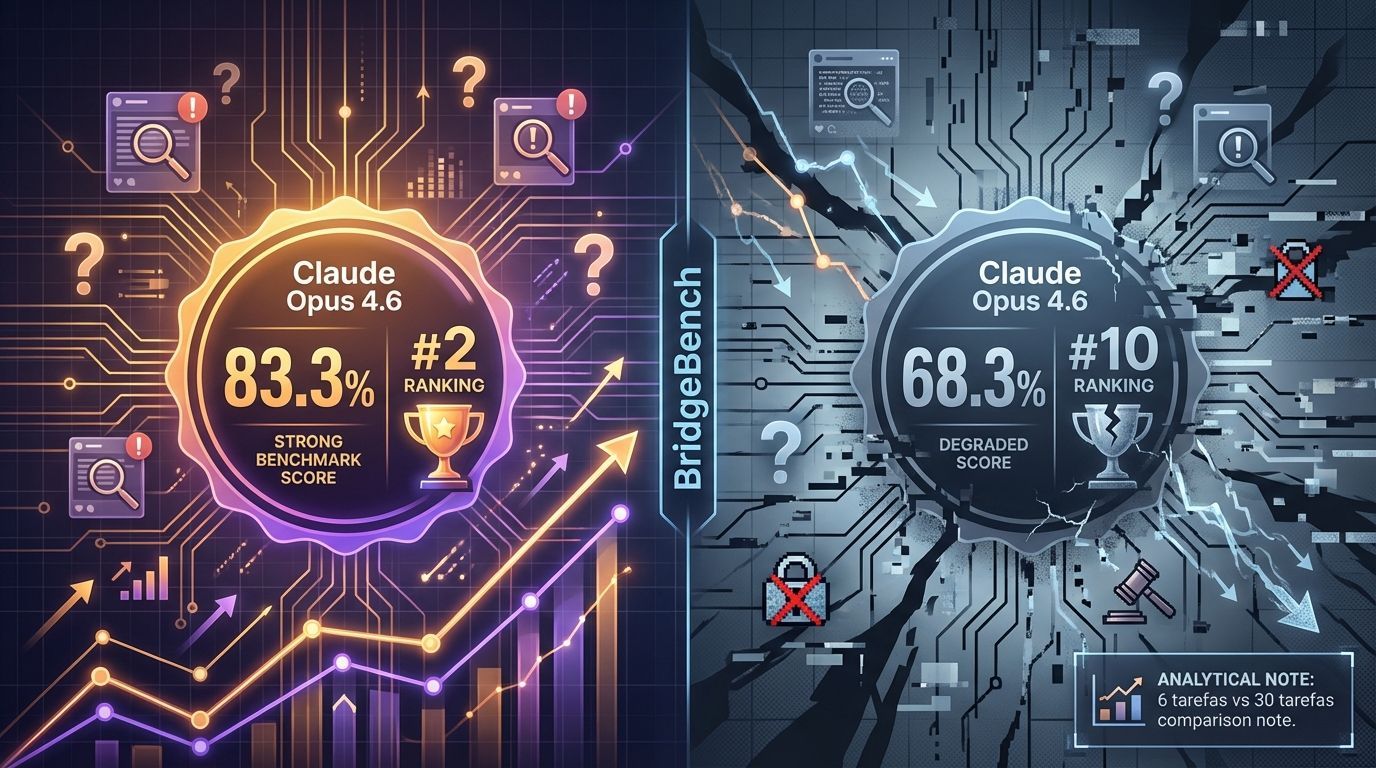

A alegação baseada em benchmark mais ruidosa veio do BridgeMind, que administra o benchmark de alucinação BridgeBench. Em 12 de abril, a conta postou que o Claude Opus 4.6 havia caído de 83,3% de precisão e uma classificação nº 2 em um resultado anterior para 68,3% de precisão e nº 10 em um novo teste.

Esse post se espalhou amplamente e se tornou uma das principais âncoras para o caso público de que a Anthropic havia degradado o modelo.

Outros usuários também circularam posts relacionados a benchmarks ou testes sugerindo que o Opus 4.6 estava com desempenho inferior ao Opus 4.5 em tarefas práticas de codificação.

O efeito foi cumulativo: capturas de tela de benchmarks, testes lado a lado e frustração anedótica começaram a se reforçar mutuamente em público.

Críticos das alegações de benchmark dizem que a evidência é mais fraca do que parece

A refutação mais importante à alegação do BridgeBench não veio da Anthropic. Veio de Paul Calcraft, um pesquisador externo de software e IA no X, que argumentou que a comparação viral era enganosa porque o resultado anterior do Opus 4.6 foi baseado em apenas seis tarefas, enquanto o posterior foi baseado em 30.

Em suas palavras, era um "BENCHMARK DIFERENTE". Ele também disse que nas seis tarefas que as duas execuções compartilhavam em comum, a pontuação do Claude mudou apenas modestamente, de 87,6% anteriormente para 85,4% na execução posterior.

Essa refutação externa importa porque enfraquece uma das alegações mais limpas e virais em circulação. Não prova que os usuários estão errados ao pensar que algo mudou, mas sugere que pelo menos algumas das evidências de benchmark agora impulsionando a história podem estar exageradas, mal normalizadas ou não diretamente comparáveis.

Limites de capacidade anteriores deram aos usuários motivo para suspeitar de mais mudanças

O atual backlash também acontece à sombra de uma mudança real e confirmada de política da Anthropic do final de março. Em 26 de março, Thariq Shihipar, funcionário técnico da Anthropic, postou que "Para gerenciar a crescente demanda pelo Claude", a empresa estava ajustando como os limites de sessão de 5 horas funcionam para assinantes Free, Pro e Max durante horários de pico.

Ele acrescentou que durante os dias de semana das 5h às 11h, horário do Pacífico, os usuários passariam pelos limites de sessão de 5 horas mais rapidamente do que antes.

A questão do prompt caching e TTL

Uma issue separada e mais recente no GitHub amplia a disputa para além da qualidade do modelo, adentrando comportamento de preços e cotas. Na issue #46829, o usuário seanGSISG argumentou que o time-to-live (TTL) do prompt-cache do Claude Code pareceu mudar de uma configuração de uma hora de volta para uma configuração de cinco minutos no início de março.

A reclamação argumenta que essa mudança levou a aumentos significativos nos custos de criação de cache e queima de cota, especialmente para sessões longas de codificação onde o contexto em cache expira rapidamente e deve ser reconstruído.

Configuração | Antes de março | Depois de março |

|---|---|---|

TTL do cache | 1 hora | 5 minutos |

Impacto | Menor custo para sessões longas | Maior custo de recriação de cache |

Uso de cota | Moderado | Mais acelerado |

Em uma resposta na thread, Jarred Sumner disse que a mudança de 6 de março foi real e intencional, mas rejeitou o enquadramento de que era uma regressão. Ele disse que o Claude Code usa diferentes durações de cache para diferentes tipos de requisição, e que cache de uma hora nem sempre é mais barato.

Anthropic diz que mudanças voltadas ao usuário, não degradação secreta, explicam a maior parte do alvoroço

Funcionários afiliados à Anthropic têm rebatido publicamente as acusações mais amplas. Em uma resposta amplamente circulada no X, Cherny respondeu a alegações de que a Anthropic havia secretamente "nerfado" o Claude Code escrevendo: "Isso é falso".

Ele disse que o Claude Code foi padronizado para medium effort em resposta ao feedback dos usuários de que o Claude estava consumindo muitos tokens, e que a mudança havia sido divulgada tanto no changelog quanto em um diálogo mostrado aos usuários quando eles abriam o Claude Code.

A documentação pública também apoia o fato de que os padrões de effort estiveram em movimento. O changelog do Claude Code diz que em 7 de abril, a Anthropic mudou o nível de effort padrão de medium para high para usuários de API-key, bem como usuários do Bedrock, Vertex, Foundry, Team e Enterprise.

A questão real pode ser confiança tanto quanto qualidade do modelo

O que está claro é que uma lacuna de confiança se abriu entre a Anthropic e alguns de seus usuários mais exigentes.

Para desenvolvedores que dependem do Claude Code o dia todo, mudanças sutis na saída de raciocínio visível, padrões de effort, queima de tokens, compensações de latência ou limites de uso podem parecer indistinguíveis de um modelo mais fraco.

Perguntas Frequentes (FAQ)

A Anthropic realmente degradou o Claude Opus 4.6?

A Anthropic nega ter degradado o modelo. A empresa afirma que as mudanças percebidas pelos usuários são resultado de ajustes em configurações de produto, como effort defaults e exibição de raciocínio, não de alterações nos pesos do modelo.

O que é "AI shrinkflation"?

É um termo criado pelos usuários para descrever a percepção de que estão recebendo um produto de IA de qualidade inferior pelo mesmo preço, sem comunicação clara da empresa sobre as mudanças.

As evidências de benchmark são confiáveis?

Alguns críticos apontaram que comparações de benchmark virais podem ser enganosas porque comparam resultados de diferentes conjuntos de tarefas ou não são normalizadas adequadamente.

O que mudou nos limites de uso do Claude?

Em março de 2026, a Anthropic ajustou como os limites de sessão de 5 horas funcionam durante horários de pico (5h-11h, horário do Pacífico), fazendo com que cerca de 7% dos usuários atinjam seus limites mais rapidamente.

Como posso obter mais raciocínio estendido do Claude Code?

Usuários podem mudar manualmente o nível de esforço digitando /effort high nas sessões de terminal do Claude Code.

Isso é verdade seja a causa raiz uma configuração de produto, uma mudança de UI, um ajuste de política de inferência, pressão de capacidade ou uma regressão genuína de qualidade. Também significa que ambos os lados da discussão podem estar falando sem se entender.

Usuários estão descrevendo o que experimentam: mais atrito, mais falhas e menos confiança. A Anthropic está respondendo em termos de produto: padrões de effort, resumos de raciocínio ocultos, divulgações de changelog e negações de que a pressão de demanda está causando degradação secreta do modelo.

Essas não são necessariamente descrições incompatíveis. Um modelo pode parecer pior para os usuários mesmo que a empresa acredite que não "nerfou" o modelo subjacente da maneira que os críticos alegam. Mas em um momento em que a rival OpenAI pivotou recentemente e colocou mais recursos em seu produto concorrente Codex, focado em enterprise e vibe-coding — oferecendo inclusive uma nova assinatura mais intermediária do ChatGPT para impulsionar o uso da ferramenta — certamente não é o tipo de publicidade que beneficia a Anthropic ou sua retenção de clientes.

Ao mesmo tempo, a evidência pública permanece mista. Algumas das alegações mais virais vieram de desenvolvedores com logs detalhados e opiniões fortes baseadas em uso repetido. Algumas das evidências de benchmark foram desafiadas por observadores externos em bases metodológicas. E as próprias mudanças recentes da Anthropic em limites e configurações garantem que esse debate esteja acontecendo em um contexto de ajustes reais, não puro rumor.