- Data Hackers Newsletter

- Posts

- Anthropic Mythos: segurança real ou estratégia para proteger contratos enterprise?

Anthropic Mythos: segurança real ou estratégia para proteger contratos enterprise?

Estratégia de lançamento de novo modelo de IA gera dúvidas sobre as reais intenções da empresa

A Anthropic anunciou esta semana uma abordagem inédita para o lançamento de seu mais novo modelo de IA, o Mythos. Ao invés de disponibilizar o modelo para o público em geral, a empresa optou por um lançamento restrito apenas para grandes corporações e organizações que operam infraestruturas críticas online - de Amazon Web Services a JPMorgan Chase.

A justificativa oficial? O Mythos seria "perigoso demais" para ser liberado amplamente, devido à sua capacidade excepcional de identificar vulnerabilidades de segurança em softwares utilizados por milhões de pessoas ao redor do mundo.

Mas será que essa decisão está realmente focada em proteger a internet - ou em proteger o modelo de negócio da própria Anthropic?

O que a Anthropic diz sobre o Mythos

Segundo a empresa, o Mythos representa um salto significativo em relação ao modelo anterior, o Opus. A capacidade de encontrar e explorar vulnerabilidades de segurança teria aumentado drasticamente, tornando o modelo uma ferramenta potencialmente perigosa se caísse nas mãos erradas.

A estratégia da Anthropic é clara: fornecer acesso prioritário ao Mythos para grandes empresas através do programa Glasswing, permitindo que essas organizações identifiquem e corrijam falhas de segurança antes que agentes maliciosos possam explorá-las usando modelos similares.

A OpenAI, rival direta da Anthropic, estaria supostamente considerando uma abordagem semelhante para sua próxima ferramenta de cybersecurity, segundo reportagem da Axios.

Mas o Mythos é realmente tão poderoso quanto parece?

Aqui é onde a narrativa começa a ficar interessante. Dan Lahav, CEO da startup de cybersecurity Irregular, levantou pontos importantes sobre a descoberta de vulnerabilidades por IA em entrevista ao TechCrunch:

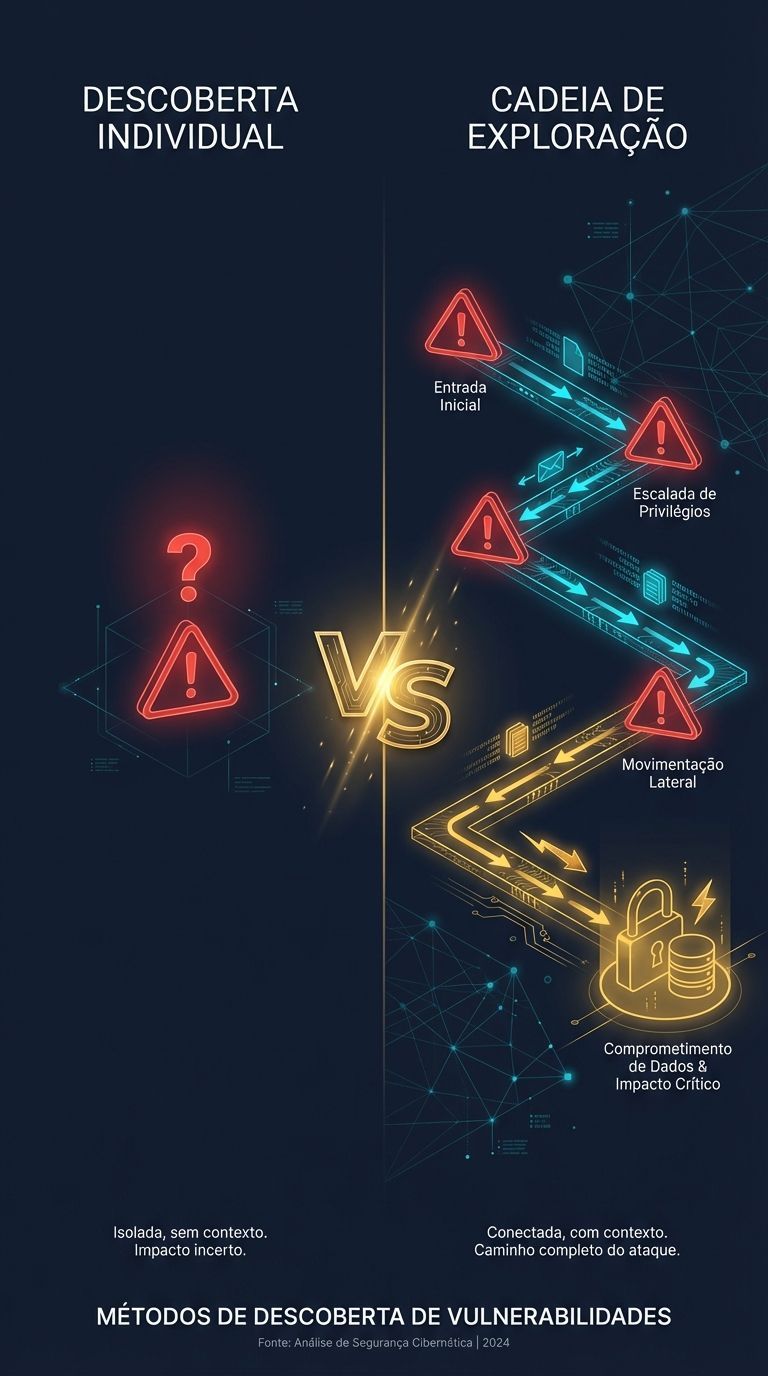

"A questão que sempre tenho em mente é: eles encontraram algo que é explorável de uma maneira muito significativa, seja individualmente ou como parte de uma cadeia?"

A descoberta de vulnerabilidades importa, mas o valor específico de qualquer fraqueza para um atacante depende de múltiplos fatores, incluindo como podem ser combinadas e exploradas na prática.

A Aisle desafia a narrativa da Anthropic

Mais revelador ainda foi o experimento realizado pela Aisle, uma startup de cybersecurity com IA. A equipe conseguiu replicar grande parte das capacidades que a Anthropic atribui ao Mythos - mas utilizando modelos menores e open-weight.

Essa descoberta é fundamental porque:

Sugere que não existe um único modelo de deep learning definitivo para cybersecurity

Indica que o desempenho depende mais da tarefa específica do que do tamanho do modelo

Questiona se o Mythos representa realmente um avanço tão radical quanto a Anthropic alega

A verdadeira razão por trás do lançamento restrito?

David Crawshaw, engenheiro de software e CEO da startup exe.dev, ofereceu uma perspectiva alternativa em suas redes sociais:

"Isso é uma cobertura de marketing para o fato de que os modelos de ponta agora estão restritos por acordos enterprise e não estão mais disponíveis para pequenos labs fazerem distillation."

O que é distillation e por que importa?

Distillation (destilação) é uma técnica que permite treinar novos modelos de IA de forma econômica, aproveitando modelos frontier existentes. Funciona assim:

Método Tradicional | Distillation |

|---|---|

Requer bilhões de dólares em treinamento | Usa modelo existente como "professor" |

Necessita infraestrutura massiva | Reduz drasticamente custos de computação |

Dominado por grandes labs | Acessível para startups e pesquisadores |

A distillation representa uma ameaça direta ao modelo de negócio dos frontier labs porque elimina a vantagem competitiva obtida através do uso de enormes quantias de capital para escalar.

A guerra contra a distillation está esquentando

Em 2026, os frontier labs intensificaram suas ações contra a prática de distillation:

Movimentos recentes:

Anthropic revelou publicamente tentativas de empresas chinesas de copiar seus modelos

Três grandes labs (Anthropic, Google e OpenAI) se uniram para identificar e bloquear distillers

Lançamentos restritos de modelos como Mythos dificultam o acesso para técnicas de cópia

Segundo reportagem da Bloomberg, essa cooperação entre concorrentes demonstra o quanto a distillation é vista como ameaça existencial para o modelo de negócio dessas empresas.

Cybersecurity ou proteção do modelo de negócio enterprise?

A análise de Crawshaw ganha ainda mais credibilidade quando consideramos o contexto atual do mercado de IA:

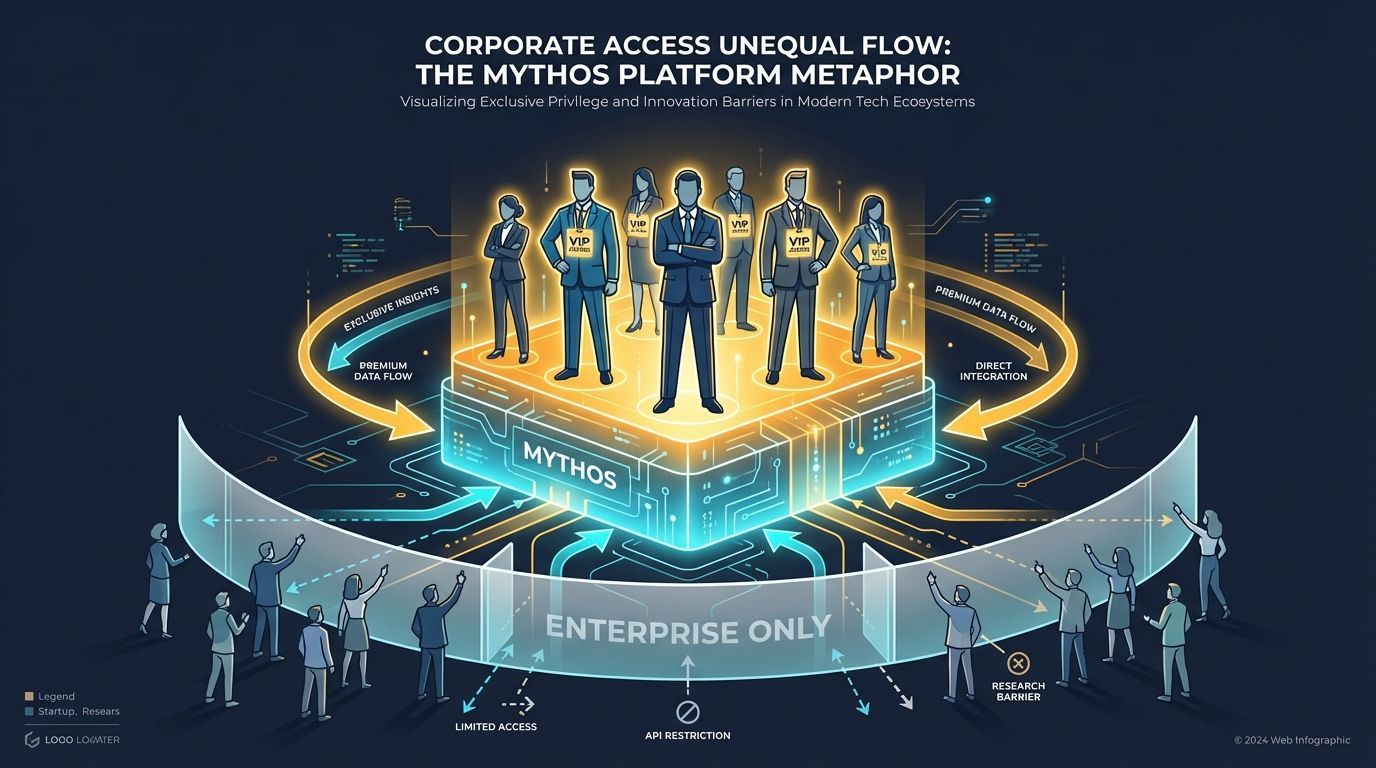

O ecossistema está polarizado:

Frontier labs: desenvolvem os maiores e mais capazes modelos, focando em contratos enterprise de alto valor

Startups como Aisle: aproveitam múltiplos modelos, incluindo LLMs open source (muitos vindos da China, alegadamente desenvolvidos via distillation)

A abordagem de lançamento seletivo do Mythos cria um ciclo virtuoso para a Anthropic:

Grandes empresas recebem acesso exclusivo ao modelo mais avançado

Isso justifica contratos enterprise de alto valor

Pequenos labs e pesquisadores ficam relegados a modelos anteriores

A distillation é dificultada, protegendo a vantagem competitiva

Quando o Mythos for liberado, já haverá uma nova versão enterprise-only

FAQ: Entendendo o caso Mythos

O Mythos representa realmente um risco para a segurança da internet?

Possivelmente sim, mas o nível exato de ameaça é debatível. O fato de startups conseguirem replicar funcionalidades similares com modelos menores sugere que a narrativa pode estar sendo exagerada.

Por que a Anthropic não poderia estar sendo transparente sobre ambas as preocupações?

É possível que tanto questões de segurança quanto proteção do modelo de negócio sejam fatores legítimos. A questão é qual deles pesa mais na decisão.

O lançamento restrito é uma tendência que veio para ficar?

Muito provavelmente. Com a intensificação da guerra contra distillation e o foco em contratos enterprise, espera-se que mais modelos frontier sigam esse caminho.

Isso é ruim para a pesquisa e inovação?

Depende da perspectiva. Grandes empresas terão acesso às melhores ferramentas, mas pesquisadores independentes e startups podem ficar em desvantagem - a menos que apostem em abordagens alternativas usando modelos menores e especializados.

O que vem por aí

A Anthropic não respondeu às perguntas do TechCrunch sobre se a decisão também se relaciona com preocupações sobre distillation até o fechamento da reportagem original.

Independentemente das motivações reais, o caso Mythos estabelece um precedente importante: modelos frontier podem não estar mais disponíveis para todos, mas reservados para quem pode pagar por contratos enterprise premium.

Essa mudança tem implicações profundas:

Para grandes empresas: acesso preferencial a ferramentas de ponta pode aumentar vantagens competitivas

Para startups: necessidade de apostar em inovação com recursos limitados e modelos alternativos

Para o ecossistema: possível fragmentação entre aqueles com e sem acesso aos modelos mais avançados

Conclusão: uma abordagem inteligente (mas para quem?)

Seja qual for a verdadeira motivação, a Anthropic pode ter encontrado uma estratégia astuta que serve a múltiplos propósitos:

✓ Demonstra responsabilidade com lançamentos de IA

✓ Justifica e fortalece contratos enterprise de alto valor

✓ Dificulta a prática de distillation

✓ Mantém vantagem competitiva no mercado

Um lançamento cuidadoso do Mythos é certamente uma abordagem responsável. A questão que fica é: a Anthropic está protegendo a internet - ou principalmente seu próprio modelo de negócio?

Apenas o tempo dirá se essa estratégia de lançamento restrito se tornará o padrão da indústria ou se enfrentará resistência de pesquisadores, reguladores e da comunidade open source.